Load balancer : Définition, fonctionnement et avantages

Dans un monde numérique où les applications doivent être rapides, disponibles en permanence et capables de gérer un grand nombre d’utilisateurs simultanés, la gestion du trafic devient un enjeu critique. Une simple surcharge peut entraîner des ralentissements, voire des interruptions de service.

Dans un monde numérique où les applications doivent être rapides, disponibles en permanence et capables de gérer un grand nombre d’utilisateurs simultanés, la gestion du trafic devient un enjeu critique. Une simple surcharge peut entraîner des ralentissements, voire des interruptions de service.

C’est dans ce contexte qu’intervient le load balancer, un composant clé des architectures modernes qui permet d’assurer performance, stabilité et continuité de service.

Qu’est-ce qu’un load balancer ?

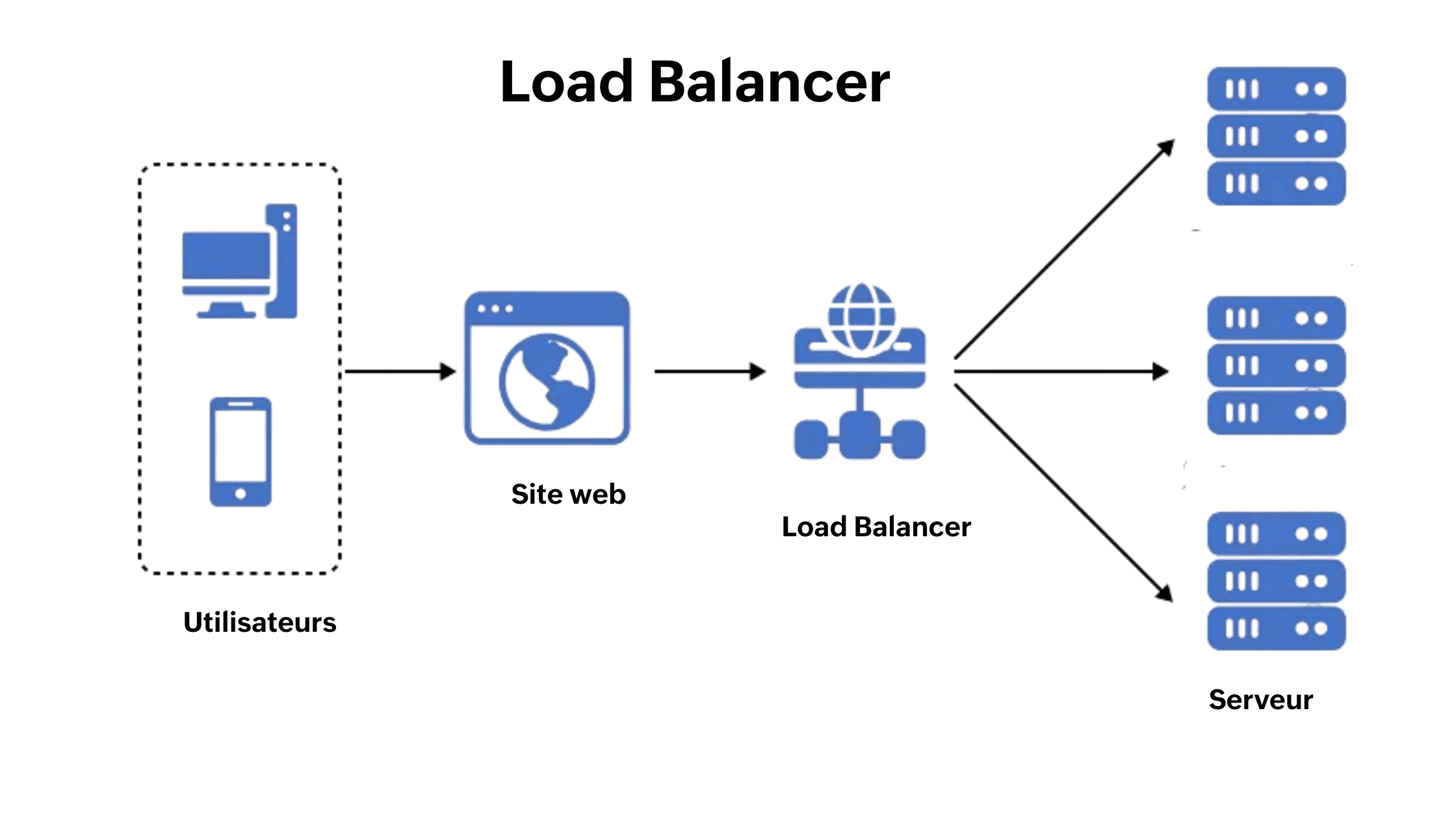

Un load balancer est un composant qui agit comme intermédiaire entre les utilisateurs et plusieurs serveurs backend. Son rôle principal est de distribuer les requêtes entrantes de manière équilibrée afin d’éviter qu’un serveur unique ne devienne un point de saturation ou de défaillance.

Plutôt que de laisser toutes les requêtes arriver au même endroit, il analyse l’état des serveurs disponibles et redirige le trafic vers ceux qui sont les plus aptes à répondre.

Ses fonctions principales incluent :

La répartition intelligente du trafic réseau

La réduction des temps de réponse pour les utilisateurs

L’élimination des points uniques de défaillance

Le maintien de la continuité de service

Grâce à ce mécanisme, les applications restent accessibles et performantes, même en cas de forte affluence.

Types de load balancer

Il existe différents types de load balancer, adaptés aux besoins réseau, applicatifs et géographiques des infrastructures modernes.

Les principaux types sont :

Load balancing réseau (Layer 4)

S’appuie sur les informations IP et ports

Très rapide pour le trafic TCP/UDP

Moins précis pour une répartition fine de la charge

Load balancing HTTP(S) (Layer 7)

Fonctionne au niveau applicatif

Permet un routage basé sur l’URL ou les en-têtes

Idéal pour les applications web

Load balancing interne

Réservé au trafic au sein de l’infrastructure

Optimise les performances des services internes

Selon le mode de déploiement, on distingue également :

Load balancer matériel : performant mais coûteux et peu flexible

Load balancer logiciel : économique et adaptable

Load balancer virtuel : version virtualisée d’un équipement matériel

Fonctionnement d’un load balancer

Le load balancing est assuré grâce à un outil ou une application appelée load balancer. Qu’il soit matériel ou logiciel, son objectif principal reste le même : répartir le trafic réseau entre plusieurs serveurs afin d’éviter toute surcharge et de garantir des performances constantes.

Lorsqu’un utilisateur accède à un site web ou à une application, de nombreuses requêtes peuvent être envoyées simultanément. Sans mécanisme de répartition, un seul serveur pourrait rapidement atteindre ses limites. Le load balancer intervient alors pour analyser et distribuer intelligemment ces requêtes.

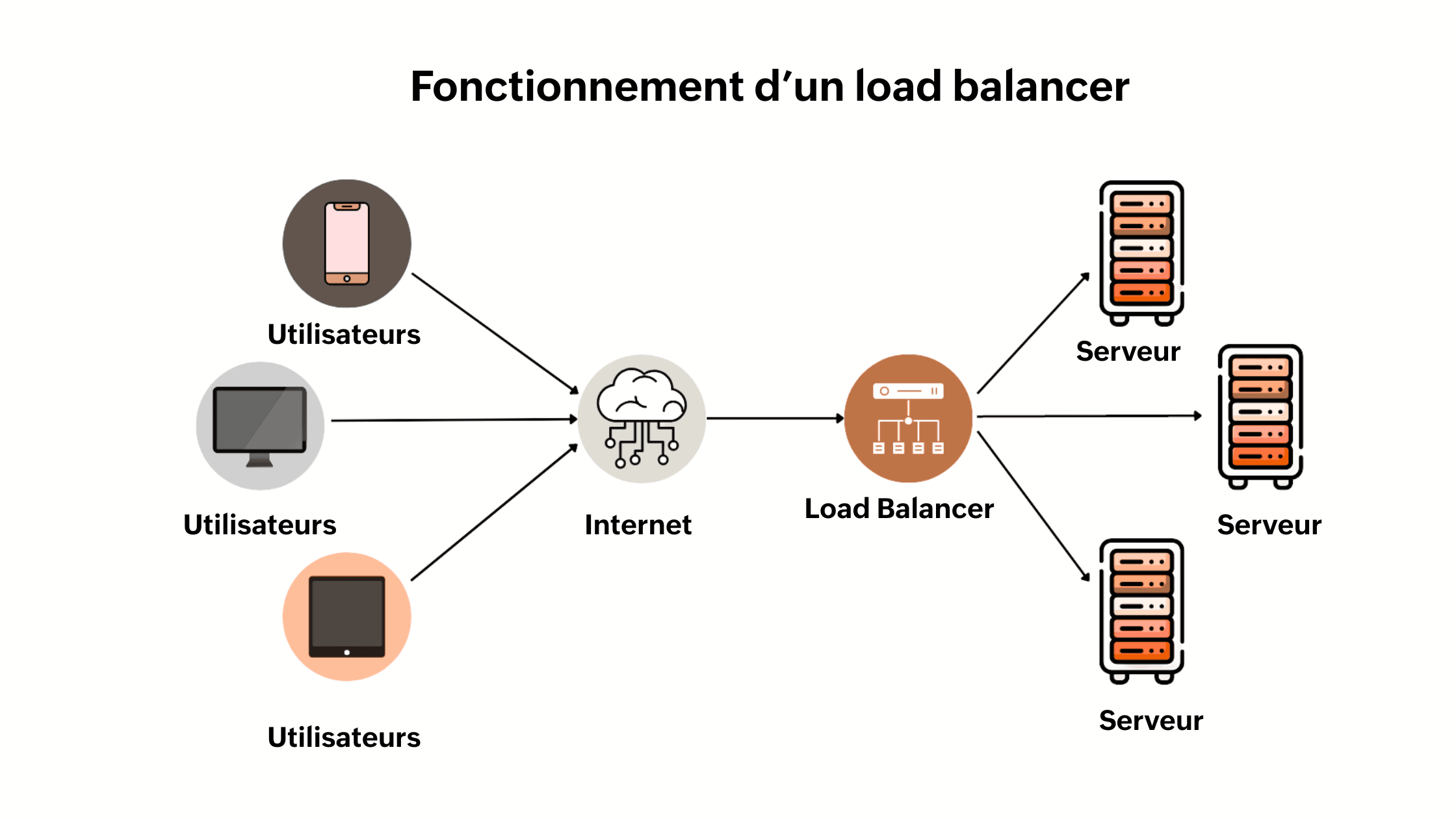

Le processus de fonctionnement peut être décrit en plusieurs étapes :

Réception du trafic

Le site web reçoit des requêtes provenant de plusieurs utilisateurs en même temps

Chaque action (chargement de page, clic, requête API) génère une demande vers le serveur

Analyse et interception des requêtes

Le load balancer intercepte chaque requête entrante

Il examine les paramètres de la requête ainsi que l’état des serveurs disponibles

Répartition vers les ressources serveur

La requête est dirigée vers le serveur le plus approprié

Le choix dépend de la charge actuelle, de la disponibilité et des règles de répartition définies

Gestion de la charge des serveurs

Chaque serveur fonctionne avec une charge raisonnable

Lorsqu’un serveur peut accepter une requête, il informe le load balancer qu’il n’est pas surchargé

Traitement et réponse

Le serveur traite la requête reçue

Il renvoie ensuite la réponse vers l’utilisateur final, complétant ainsi le cycle

À chaque requête, le load balancer choisit le serveur le plus adapté afin d’assurer une répartition équilibrée, une haute disponibilité et une expérience utilisateur fluide.

Importance du load balancer

L’importance d’un load balancer va bien au-delà de la simple optimisation des performances. Il joue un rôle stratégique dans la fiabilité globale des systèmes informatiques.

Ses bénéfices majeurs comprennent :

Haute disponibilité des services, même en cas de panne matérielle

Scalabilité horizontale, facilitant l’ajout de nouveaux serveurs

Amélioration de l’expérience utilisateur grâce à des temps de réponse stables

Meilleure résilience face aux pics de trafic imprévus

Dans les environnements cloud et SaaS, il est essentiel pour accompagner la croissance des applications sans compromettre leur stabilité.

ManageEngine et le load balancer

Les solutions ManageEngine permettent d’accompagner efficacement l’utilisation d’un load balancer en offrant une visibilité complète sur les performances, la disponibilité et la santé des infrastructures IT.

Parmi les outils clés :

Surveille en temps réel l’état des serveurs, des applications et des équipements réseau.

Permet de suivre la charge CPU, mémoire, bande passante et latence.

Aide à détecter les déséquilibres de charge pouvant impacter les performances.

Offre une supervision approfondie des applications web et des services backend.

Permet d’analyser les temps de réponse et la disponibilité des applications réparties.

Aide à identifier si un ralentissement provient de l’application ou de l’infrastructure.

Analyse les flux réseau pour comprendre la répartition du trafic.

Identifie les pics de bande passante et les goulots d’étranglement.

Utile pour optimiser les règles de répartition du trafic.

Surveille la disponibilité des applications depuis différents emplacements géographiques.

Permet de vérifier l’impact du load balancing sur l’expérience utilisateur réelle.

Aide à anticiper les incidents avant qu’ils n’affectent les utilisateurs finaux.

En combinant un load balancer avec les solutions ManageEngine, les équipes IT bénéficient d’une supervision centralisée, assurant continuité de service et performances optimisées.

Conclusion

Le load balancer est aujourd’hui un composant indispensable des architectures informatiques modernes. En répartissant intelligemment le trafic, il garantit la disponibilité, la performance et la résilience des applications, même dans des contextes de forte demande. Associé à des outils de supervision performants, il permet aux entreprises de sécuriser leurs services numériques, d’accompagner leur croissance et d’offrir une expérience utilisateur fiable et continue.