Deepfake AI หรือ AI Deepfake คืออะไร องค์กรต้องป้องกันอย่างไร

ในยุคดิจิทัลที่ทุกอย่างถูกสร้างและแชร์ได้ภายในไม่กี่วินาที Deepfake Ai กำลังกลายเป็นเทคโนโลยีที่สร้างทั้งโอกาสและความเสี่ยงอย่างมหาศาล ไม่ว่าจะเป็นภาพ เสียง หรือ Ai Deepfake Video ที่ดูสมจริงจนแทบแยกไม่ออกว่าเป็นของจริงหรือถูกสร้างขึ้นด้วยปัญญาประดิษฐ์

หลายคนอาจยังสงสัยว่า Ai Deepfake คืออะไร และเกี่ยวข้องกับองค์กรอย่างไร ความน่ากังวลไม่ได้อยู่ที่เทคโนโลยีเพียงอย่างเดียว แต่คือการนำไปใช้ในทางที่ผิด เช่น การปลอมแปลงผู้บริหาร การหลอกโอนเงิน หรือการโจมตีชื่อเสียงองค์กร บทความนี้จะพาคุณทำความเข้าใจภัยคุกคามจาก Deepfake Ai พร้อมแนวทางตรวจจับและป้องกัน เพื่อให้องค์กรสามารถรับมือกับความเสี่ยงรูปแบบใหม่นี้ได้อย่างมั่นใจ

AI Deepfake คืออะไร

Ai Deepfake คือ เทคโนโลยีที่ใช้ปัญญาประดิษฐ์ (Artificial Intelligence) สร้างหรือดัดแปลงภาพ เสียง และวิดีโอให้ดูเสมือนจริง โดยทำให้บุคคลหนึ่งพูดหรือกระทำในสิ่งที่ไม่เคยเกิดขึ้นจริง เทคโนโลยีนี้อาศัยเทคนิคด้าน Machine Learning และ Deep Learning เพื่อวิเคราะห์ใบหน้า น้ำเสียง และพฤติกรรม ก่อนนำมาสร้างเป็น Ai Deepfake Video ที่มีความสมจริงสูง

หากอธิบายให้เข้าใจง่ายขึ้น เทคโนโลยี Deepfake คืออะไร ก็คือการ “สลับ” หรือ “สร้างใหม่” ข้อมูลดิจิทัลโดยใช้โมเดลปัญญาประดิษฐ์ ซึ่งต่างจากการตัดต่อวิดีโอแบบเดิม เพราะระบบสามารถเรียนรู้รายละเอียดระดับโครงหน้า การขยับริมฝีปาก และโทนเสียงได้อย่างแม่นยำ

ปัจจุบัน Deepfake Ai ถูกใช้ทั้งในด้านความบันเทิง การตลาด และงานสร้างสรรค์ แต่ในขณะเดียวกันก็ถูกนำไปใช้ในทางที่ผิด เช่น การปลอมตัว หลอกลวง หรือสร้างข้อมูลเท็จ จึงทำให้ประเด็นเรื่องความปลอดภัยและการตรวจจับ กลายเป็นสิ่งสำคัญที่องค์กรต้องให้ความใส่ใจมากขึ้น

ประวัติของ Deepfake AI

เทคโนโลยี Deepfake Ai เริ่มเป็นที่รู้จักในช่วงปี 2017 เมื่อมีผู้ใช้งานบนแพลตฟอร์มออนไลน์นำเทคนิคปัญญาประดิษฐ์มาใช้สลับใบหน้าในวิดีโอ และเผยแพร่สู่สาธารณะ คำว่า “Deepfake” มาจากการผสมระหว่างคำว่า Deep Learning และ Fake ซึ่งสะท้อนถึงการใช้โมเดลเรียนรู้เชิงลึกในการสร้างภาพหรือวิดีโอปลอม

ในช่วงแรก Ai Deepfake ถูกใช้ในวงการบันเทิงและงานทดลองด้านเทคโนโลยี เช่น การสลับใบหน้าในภาพยนตร์ หรือสร้างคอนเทนต์เลียนแบบบุคคลมีชื่อเสียง ต่อมาเมื่อเครื่องมืออย่าง Ai Deepfake Software ถูกพัฒนาให้ใช้งานง่ายขึ้น ผู้ใช้ทั่วไปก็สามารถสร้าง Ai Deepfake Video ได้โดยไม่จำเป็นต้องมีความรู้ด้านเทคนิคขั้นสูง

อย่างไรก็ตาม เมื่อเทคโนโลยีพัฒนาไปอย่างรวดเร็ว ความกังวลด้านความปลอดภัยก็เพิ่มขึ้นเช่นกัน หลายประเทศเริ่มถกเถียงถึงประเด็นว่า Deepfake ผิดกฎหมาย หรือไม่ โดยเฉพาะกรณีที่เกี่ยวข้องกับการฉ้อโกง การบิดเบือนข้อมูล หรือการละเมิดสิทธิส่วนบุคคล ส่งผลให้ Deepfake Ai ไม่ได้เป็นเพียงนวัตกรรมใหม่ แต่กลายเป็นประเด็นสำคัญด้าน Cybersecurity และ Digital Governance ในระดับโลก

ผลกระทบของ AI Deepfake ต่อองค์กร

การพัฒนาอย่างรวดเร็วของ Deepfake Ai ไม่ได้ส่งผลกระทบแค่ในระดับบุคคล แต่สร้างความเสี่ยงเชิงโครงสร้างต่อองค์กร ทั้งด้านการเงิน ชื่อเสียง และความมั่นคงทางไซเบอร์ หากไม่มีมาตรการป้องกันที่เหมาะสม ความเสียหายอาจเกิดขึ้นได้ภายในเวลาไม่กี่ชั่วโมง

ความเสียหายทางการเงิน (Financial Loss)

หนึ่งในผลกระทบที่รุนแรงที่สุดคือการหลอกโอนเงินผ่าน Ai Deepfake Video หรือเสียงปลอมผู้บริหาร ผู้โจมตีอาจใช้ Ai Deepfake Software สร้างคลิปหรือเสียงเลียนแบบ CEO หรือ CFO เพื่อสั่งการโอนเงินเร่งด่วน ส่งผลให้องค์กรสูญเสียเงินจำนวนมากโดยที่พนักงานไม่ทันสงสัย

ความเสียหายต่อชื่อเสียงองค์กร (Reputation Damage)

การเผยแพร่วิดีโอปลอมที่แสดงให้เห็นผู้บริหารกล่าวถ้อยคำไม่เหมาะสม หรือประกาศข้อมูลเท็จ สามารถทำลายความเชื่อมั่นของลูกค้าและนักลงทุนได้ทันที แม้ภายหลังจะพิสูจน์ได้ว่าเป็น Deepfake Ai แต่ความเสียหายด้านภาพลักษณ์อาจยากต่อการฟื้นฟู

ความเสี่ยงด้านกฎหมายและการกำกับดูแล (Legal And Compliance Risk)

หลายประเทศเริ่มพิจารณาว่า Deepfake ผิดกฎหมาย ในบางบริบท โดยเฉพาะกรณีที่เกี่ยวข้องกับการฉ้อโกงหรือการละเมิดสิทธิส่วนบุคคล หากองค์กรตกเป็นเหยื่อหรือเผลอเผยแพร่เนื้อหาปลอม อาจเผชิญความเสี่ยงด้านกฎหมาย และการตรวจสอบจากหน่วยงานกำกับดูแล

ความเสี่ยงด้าน Cybersecurity และ Social Engineering

Deepfake Ai ถูกนำมาใช้ร่วมกับเทคนิค Social Engineering เพื่อเพิ่มความน่าเชื่อถือในการโจมตี เช่น การปลอมตัวเป็นคู่ค้าหรือเจ้าหน้าที่ไอที การโจมตีลักษณะนี้ทำให้การยืนยันตัวตนแบบดั้งเดิมไม่เพียงพอ และทำให้องค์กรต้องให้ความสำคัญกับแนวทาง Ai Deepfake Detection คือ การใช้เทคโนโลยีตรวจจับความผิดปกติของภาพ เสียง และพฤติกรรมดิจิทัลมากขึ้น

ตัวอย่างสถานการณ์ AI Deepfake ในประเทศไทย

เพื่อให้เข้าใจมากขึ้นต่อไปนี้เป็นตัวอย่าง เหตุการณ์จริง ที่เป็น Deepfake ผิดกฎหมายที่เกี่ยวข้องกับการใช้ เทคโนโลยี AI ในการสร้างภาพ/เสียงปลอมเพื่อหลอกลวงหรือบิดเบือนข้อมูล ซึ่งสะท้อนว่าภัยนี้ไม่ใช่เรื่องไกลตัวอีกต่อไป

คลิปปลอมอ้างนักการเมืองแถลงข่าวซื้อเสียง

มีรายงานว่ามีคลิป AI Deepfake Video แสดงภาพบุคคลที่ถูกอ้างว่าเป็น “เท้ง ณัฐพงษ์” กำลังแถลงเกี่ยวกับการซื้อเสียงพรรคการเมือง แต่เมื่อตรวจสอบแล้วพบว่าเป็นคลิปปลอมที่สร้างขึ้นด้วยเทคโนโลยี Deepfake ที่ถูกเผยแพร่ผ่านโซเชียลมีเดีย ทำให้เกิดความสับสนในสาธารณะก่อนมีการยืนยันว่าคลิปนั้นไม่เป็นความจริง

มิจฉาชีพใช้เสียงปลอมเพื่อหลอกโอนเงิน

ศูนย์ปฏิบัติการเพื่อป้องกันและปราบปรามอาชญากรรมเทคโนโลยีได้รับแจ้งคดีที่ผู้เสียหายได้รับโทรศัพท์จากบุคคลอ้างว่าเป็นลูกสาวของตน โดยเสียงนั้นถูกสร้างขึ้นด้วย AI ทำให้เหยื่อตกใจและโอนเงินให้ก่อนจะรู้ว่าคือเสียงปลอมที่ใช้กลโกง

แก๊งสแกมเมอร์ใช้ AI หลอกระบบยืนยันตัวตนของธนาคาร (KYC)

รายงานจากหน่วยงานความปลอดภัยไซเบอร์ในไทยระบุว่ากลุ่มผู้ต้องหาใช้ AI Deepfake สร้างวิดีโอปลอมจากภาพนิ่งของเหยื่อ เพื่อพยายามหลอกระบบยืนยันตัวตน (KYC) ของสถาบันการเงินและแพลตฟอร์มเงินดิจิทัล ส่งผลให้มีความเสี่ยงต่อระบบความปลอดภัยของข้อมูลในภาคการเงินมากขึ้น

เหตุการณ์เหล่านี้แสดงให้เห็นว่าการใช้ เทคโนโลยี Deepfake คืออะไร ไม่ได้เป็นแค่ภาพยนตร์หรืองานสร้างสรรค์เท่านั้น แต่ยังถูกนำมาใช้ในรูปแบบที่เป็นภัย เพื่อหลอกลวงทั้งบุคคลทั่วไปและระบบดิจิทัลขององค์กรต่าง ๆ

แนวโน้มของ AI Deepfake ในอนาคต

เทคโนโลยี Deepfake Ai กำลังพัฒนาอย่างรวดเร็ว และมีแนวโน้มจะซับซ้อนและตรวจจับได้ยากขึ้นในอนาคต องค์กรจึงจำเป็นต้องเข้าใจทิศทางของเทคโนโลยี เพื่อเตรียมกลยุทธ์ด้าน Cybersecurity และ Digital Governance ให้ทันต่อความเปลี่ยนแปลง

Real-Time Deepfake และ Live Manipulation

จากเดิมที่ Ai Deepfake Video มักถูกสร้างแบบบันทึกล่วงหน้า ปัจจุบันเริ่มมีการพัฒนา Deepfake แบบ Real-Time ที่สามารถสลับใบหน้าหรือปรับเสียงระหว่าง Video Call ได้ทันที เทรนด์นี้เพิ่มความเสี่ยงต่อการประชุมออนไลน์ การอนุมัติธุรกรรม และกระบวนการยืนยันตัวตนแบบวิดีโอ

Voice Cloning ความแม่นยำสูง

เทคโนโลยีเลียนแบบเสียงกำลังพัฒนาไปไกล เพียงใช้ตัวอย่างเสียงไม่กี่วินาที ระบบก็สามารถสร้างเสียงใหม่ที่ใกล้เคียงต้นฉบับอย่างมาก ส่งผลให้การโจมตีแบบ Social Engineering มีความแนบเนียนขึ้น และยากต่อการแยกแยะว่าเป็นเสียงจริงหรือสร้างจาก Ai Deepfake Software

AI-Generated Identity และ Synthetic Persona

แนวโน้มใหม่ไม่ใช่แค่การ “ปลอมตัวเป็นคนจริง” แต่คือการสร้างตัวตนดิจิทัลขึ้นมาใหม่ทั้งหมด ทั้งใบหน้า เสียง และประวัติออนไลน์ ซึ่งอาจถูกใช้เปิดบัญชีธนาคาร สมัครงาน หรือเข้าถึงระบบองค์กร ทำให้คำถามว่า “เทคโนโลยี Deepfake คืออะไร” ขยายไปสู่ระดับของ Digital Identity Fraud

การพัฒนา AI Deepfake Detection ขั้นสูง

ในขณะที่ Deepfake พัฒนาเร็วขึ้น เทคโนโลยีตรวจจับก็พัฒนาเช่นกัน โดยแนวโน้มของ Ai Deepfake Detection คือ การใช้ AI วิเคราะห์ Metadata ความผิดปกติของพิกเซล รูปแบบการกระพริบตา และ Pattern เสียง รวมถึงการตรวจสอบพฤติกรรมการใช้งาน (Behavioral Analytics) ควบคู่กัน ไม่พึ่งพาเพียงภาพหรือเสียงอย่างเดียว

การออกกฎหมายและมาตรฐานกำกับดูแล

หลายประเทศเริ่มพัฒนากฎหมายที่เกี่ยวข้องกับเนื้อหา Deepfake โดยเฉพาะกรณีที่เข้าข่ายฉ้อโกงหรือทำให้เกิดความเสียหายต่อบุคคลและองค์กร ซึ่งทำให้ประเด็นว่า Deepfake ผิดกฎหมาย หรือไม่ จะมีความชัดเจนมากขึ้นในอนาคต และองค์กรต้องเตรียมความพร้อมด้าน Compliance ให้สอดคล้องกับกฎระเบียบใหม่

แนวโน้มเหล่านี้สะท้อนว่า Deepfake Ai จะไม่ใช่เพียงเทคโนโลยีสร้างคอนเทนต์ แต่จะกลายเป็นหนึ่งในความท้าทายหลักด้าน Cybersecurity ที่องค์กรต้องรับมืออย่างจริงจังในยุค Digital Trust

ความต่าง Deepfake เพื่อความบันเทิง VS Deepfake เพื่อการฉ้อโกง

แม้ว่า Deepfake Ai จะใช้เทคโนโลยีเดียวกัน แต่ “วัตถุประสงค์” และ “ผลกระทบ” กลับแตกต่างกันอย่างสิ้นเชิง การเข้าใจความต่างนี้ช่วยให้องค์กรประเมินความเสี่ยงได้ชัดเจนมากขึ้น

Deepfake เพื่อความบันเทิง

การใช้ Ai Deepfake ในด้านความบันเทิงมักเกี่ยวข้องกับงานสร้างสรรค์ เช่น ภาพยนตร์ โฆษณา หรือคอนเทนต์บนโซเชียลมีเดีย ตัวอย่างเช่น การสลับใบหน้าดารา การทำคลิปล้อเลียน หรือการสร้างตัวละครเสมือนจริง โดยทั่วไปมีการเปิดเผยว่าเป็นคอนเทนต์ที่สร้างด้วย AI และไม่ได้มีเจตนาหลอกลวง

ในบริบทนี้ เทคโนโลยี Deepfake คืออะไร จึงถูกมองว่าเป็นเครื่องมือด้าน Creative Technology ที่เพิ่มประสบการณ์ใหม่ให้กับผู้ชม

Deepfake เพื่อการฉ้อโกง

ในทางกลับกัน การใช้ Deepfake Ai เพื่อการฉ้อโกงมีเป้าหมายเพื่อหลอกลวงและสร้างความเสียหาย เช่น การปลอมเสียงผู้บริหารเพื่อสั่งโอนเงิน การสร้าง Ai Deepfake Video ปลอมเพื่อบิดเบือนข้อมูล หรือการปลอมตัวเป็นเจ้าหน้าที่รัฐ ซึ่งเข้าข่ายการกระทำผิดและในหลายกรณีอาจเกี่ยวข้องกับประเด็นว่า Deepfake ผิดกฎหมาย

ลักษณะนี้มักแฝงตัวมาในรูปแบบ Social Engineering และยากต่อการตรวจสอบ หากองค์กรไม่มีระบบ Ai Deepfake Detection คือ เทคโนโลยีตรวจจับความผิดปกติของภาพและเสียง

เพื่อให้เห็นภาพชัดเจน นี่คือตารางเปรียบเทียบความแตกต่างระหว่าง Deepfake เพื่อความบันเทิงและ Deepfake เพื่อฉ้อโกง

ประเด็นเปรียบเทียบ | Deepfake เพื่อความบันเทิง | Deepfake เพื่อการฉ้อโกง |

|---|---|---|

วัตถุประสงค์ | สร้างความสนุก ความคิดสร้างสรรค์ | หลอกลวง เอื้อประโยชน์ทางการเงิน |

การเปิดเผย | มักระบุว่าเป็นคอนเทนต์ที่สร้างด้วย AI | ปกปิดว่าเป็นของปลอม |

ผลกระทบ | ผลกระทบต่ำ หากไม่ละเมิดสิทธิ | เสียหายทางการเงิน ชื่อเสียง และกฎหมาย |

ความเสี่ยงทางกฎหมาย | ต่ำ หากได้รับความยินยอม | สูง อาจเข้าข่ายอาชญากรรมไซเบอร์ |

ความจำเป็นในการตรวจจับ | ไม่จำเป็นในเชิงความมั่นคง | จำเป็นต้องมีระบบตรวจจับและควบคุม |

ประเภทของกลโกงมิจฉาชีพของ Deepfake

เมื่อ Deepfake Ai พัฒนาไปไกลกว่าการตัดต่อภาพทั่วไป มิจฉาชีพก็เริ่มนำเทคโนโลยีนี้มาใช้เป็นเครื่องมือหลอกลวงในรูปแบบที่แนบเนียนมากขึ้น ทั้งภาพ เสียง และ Ai Deepfake Video ที่ดูสมจริงจนผู้รับสารแทบไม่ทันตั้งข้อสงสัย กลโกงเหล่านี้มักผสมผสานกับเทคนิค Social Engineering เพื่อเพิ่มความน่าเชื่อถือและเร่งรัดให้เหยื่อตัดสินใจทันที

ปลอมแปลงเป็นบุคคลสำคัญ (Public Figures Fraud)

มิจฉาชีพใช้ Ai Deepfake Software สร้างวิดีโอหรือเสียงปลอมของนักการเมือง ผู้บริหาร หรือคนดัง เพื่อให้ดูเหมือนกำลังสนับสนุนการลงทุน สินค้า หรือโครงการบางอย่าง เป้าหมายคือสร้างความน่าเชื่อถือและชักจูงให้เหยื่อโอนเงินหรือให้ข้อมูลส่วนตัว กรณีลักษณะนี้สร้างผลกระทบทั้งต่อประชาชนและชื่อเสียงของบุคคลที่ถูกแอบอ้าง และในหลายประเทศเริ่มมีการพิจารณาว่า Deepfake ผิดกฎหมาย เมื่อเข้าข่ายฉ้อโกงหรือบิดเบือนข้อมูลสาธารณะ

หลอกโอนเงินผ่านการปลอมตัว (Financial Fraud)

หนึ่งในภัยที่รุนแรงที่สุดคือการปลอมเสียงหรือวิดีโอผู้บริหารเพื่อสั่งการโอนเงินด่วน ตัวอย่างเช่น การสร้างเสียงเลียนแบบ CEO ผ่าน Ai Deepfake แล้วโทรศัพท์สั่งฝ่ายการเงินให้ดำเนินธุรกรรมทันที

กลโกงลักษณะนี้อาศัยความเร่งด่วนและความเชื่อใจในโครงสร้างองค์กร ทำให้หลายบริษัททั่วโลกสูญเสียเงินจำนวนมากภายในเวลาไม่กี่ชั่วโมง

ปลอมตัวเป็นเจ้าหน้าที่รัฐ (Law Enforcement Scams)

มิจฉาชีพอาจใช้ Deepfake Ai สร้างวิดีโอหรือเสียงเลียนแบบเจ้าหน้าที่ตำรวจ เจ้าหน้าที่ศาล หรือหน่วยงานกำกับดูแล เพื่อข่มขู่หรือแจ้งข้อกล่าวหาเท็จ จากนั้นเรียกร้องให้โอนเงินเพื่อ “ยุติคดี” หรือ “ตรวจสอบบัญชี”

การปลอมตัวในลักษณะนี้เพิ่มความน่าเชื่อถือและสร้างแรงกดดันทางจิตวิทยา ทำให้เหยื่อเกิดความกลัวและรีบดำเนินการโดยไม่ตรวจสอบข้อเท็จจริง

Social Engineering ผ่าน Deepfake

Deepfake Ai มักถูกใช้เป็นเครื่องมือเสริมในการโจมตีแบบ Social Engineering เช่น การส่งคลิปวิดีโอจาก “หัวหน้างาน” ให้พนักงานคลิกลิงก์ การปลอมเสียงเพื่อนร่วมงานเพื่อขอรหัส OTP หรือการสร้างตัวตนปลอมเพื่อสร้างความสัมพันธ์ระยะยาวก่อนหลอกให้โอนเงิน

เมื่อผสาน Deepfake เข้ากับข้อมูลที่รั่วไหลจาก Social Media หรือ Data Breach การโจมตีจะยิ่งมีความแม่นยำและยากต่อการตรวจจับ ทำให้องค์กรจำเป็นต้องมีมาตรการทั้งด้านการสร้างความตระหนักรู้และเทคโนโลยีตรวจสอบควบคู่กัน

วิธีจับสังเกต AI Deepfake

แม้ว่า Deepfake Ai จะพัฒนาไปไกลจนภาพและเสียงดูสมจริงมากขึ้น แต่ยังคงมี “สัญญาณผิดปกติ” ที่สามารถสังเกตได้ หากผู้รับสารมีความระมัดระวัง โดยเฉพาะเมื่อเป็น Ai Deepfake Video ที่ใช้ในการหลอกลวงหรือฉ้อโกง

ความผิดปกติของใบหน้าและการเคลื่อนไหว : สังเกตการกระพริบตา การขยับริมฝีปาก และการแสดงสีหน้า หากการเคลื่อนไหวไม่สัมพันธ์กับคำพูด หรือมีจังหวะที่ดูแข็งเกินไป อาจเป็นสัญญาณของ Ai Deepfake นอกจากนี้ ขอบใบหน้า เส้นผม หรือแสงเงาที่ดูไม่สอดคล้องกับฉากหลัง ก็อาจบ่งชี้ถึงการตัดต่อด้วย AI

ความไม่สอดคล้องของเสียง : ในกรณีที่เป็นเสียงปลอม ให้สังเกตโทนเสียง จังหวะการหายใจ และอารมณ์ หากเสียงฟังดูเรียบเกินไป ขาดน้ำหนักธรรมชาติ หรือมีความล่าช้าระหว่างภาพกับเสียง อาจเป็นผลจากการใช้ Ai Deepfake Software ในการสร้างเสียงเลียนแบบ

คุณภาพของภาพและรายละเอียดเล็ก ๆ : Deepfake บางกรณีอาจมีความผิดเพี้ยนในรายละเอียด เช่น ฟัน นิ้วมือ แว่นตา หรือเครื่องประดับที่บิดเบี้ยวผิดธรรมชาติ รวมถึงการสะท้อนแสงที่ไม่สมจริง โดยเฉพาะในวิดีโอที่มีการเคลื่อนไหวเร็ว

เนื้อหาที่เร่งรัดหรือกดดันให้ตัดสินใจทันที : กลโกงที่ใช้ Deepfake Ai มักมาพร้อมกับความเร่งด่วน เช่น “ต้องโอนเงินทันที” หรือ “เป็นเรื่องลับห้ามบอกใคร” การสร้างแรงกดดันทางจิตวิทยาเป็นเทคนิคของ Social Engineering ที่ใช้ควบคู่กับ Deepfake เพื่อให้เหยื่อไม่ทันตรวจสอบข้อมูล

ตรวจสอบแหล่งที่มาและช่องทางติดต่อ : หากได้รับคลิปหรือวิดีโอที่ดูน่าสงสัย ควรตรวจสอบผ่านช่องทางอื่น เช่น โทรกลับผ่านเบอร์ทางการขององค์กร หรือสอบถามผ่านระบบที่ยืนยันตัวตนได้ การตรวจสอบซ้ำ (Verification) เป็นขั้นตอนพื้นฐานที่ช่วยลดความเสี่ยงได้มาก

ในระดับองค์กร การพึ่งพาเพียงการสังเกตด้วยสายตาอาจไม่เพียงพอ จึงเริ่มมีการพัฒนาเทคโนโลยีที่ตอบคำถามว่า Ai Deepfake Detection คือ การใช้ AI วิเคราะห์ความผิดปกติของภาพ เสียง และพฤติกรรมดิจิทัล เพื่อช่วยแยกแยะเนื้อหาจริงออกจากของปลอมได้แม่นยำยิ่งขึ้น

วิธีป้องกัน AI Deepfake

เมื่อ Deepfake Ai ถูกนำมาใช้ในการหลอกลวงมากขึ้น การป้องกันจึงไม่ควรพึ่งพาเพียงการสังเกตด้วยสายตา แต่ต้องอาศัยทั้งวินัยด้านความปลอดภัยของบุคลากร และเทคโนโลยีควบคุมความเสี่ยงในระดับองค์กร เพราะแม้ Ai Deepfake Video จะดูสมจริงเพียงใด หากมีระบบยืนยันและตรวจสอบที่รัดกุม ความเสียหายก็สามารถป้องกันได้

หลีกเลี่ยงการแชร์ข้อมูลผ่าน Video Call

ในยุคที่สามารถสร้าง Deepfake แบบ Real Time ได้ การประชุมผ่าน Video Call อาจไม่ใช่หลักฐานยืนยันตัวตนที่เพียงพอ โดยเฉพาะเมื่อเกี่ยวข้องกับข้อมูลสำคัญหรือคำสั่งโอนเงิน ควรหลีกเลี่ยงการอนุมัติธุรกรรมสำคัญผ่านการสื่อสารเพียงช่องทางเดียว และควรมีขั้นตอน Verify ซ้ำผ่านระบบภายในองค์กร เช่น การยืนยันผ่านอีเมลทางการ หรือระบบ Ticket ที่ตรวจสอบย้อนกลับได้

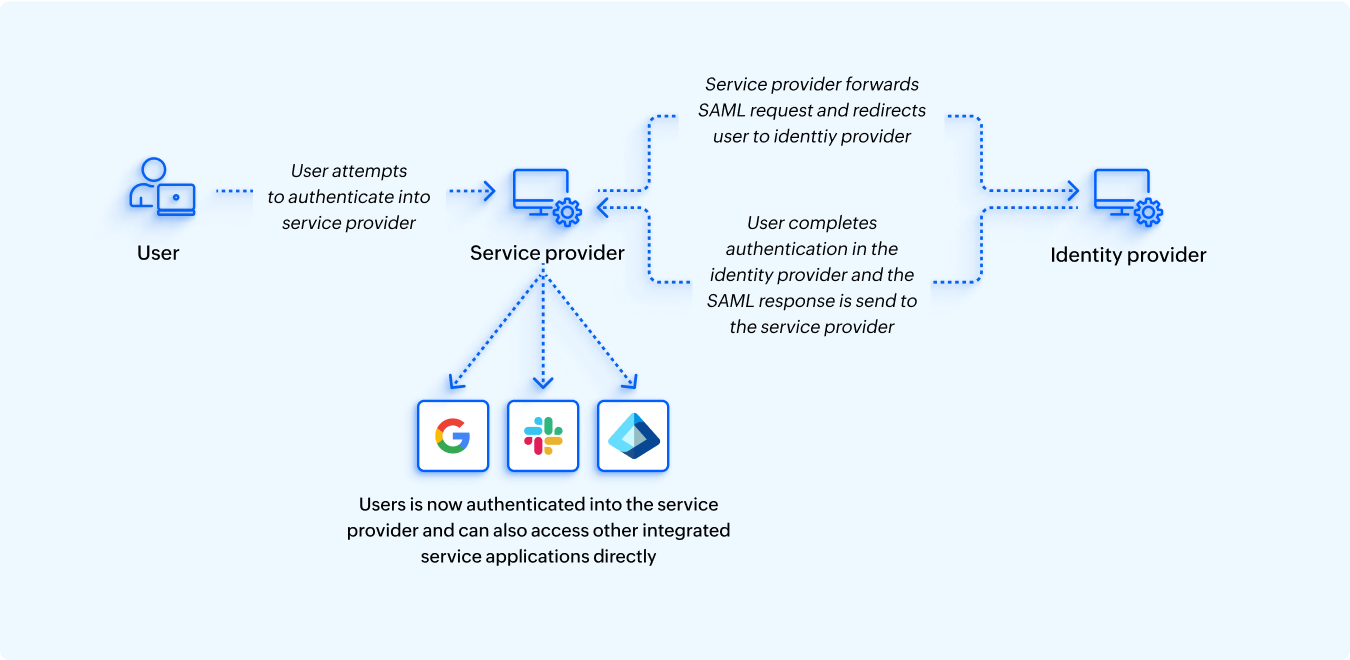

ใช้การยืนยันตัวตนสองชั้น หรือ Multi-Factor Authentication

แม้ผู้โจมตีจะใช้ Ai Deepfake Software เลียนแบบใบหน้าหรือเสียงได้ แต่ไม่สามารถข้ามระบบ Multi-Factor Authentication (MFA) ได้ง่าย การใช้ MFA ช่วยเพิ่มชั้นความปลอดภัย อย่าง OTP, Biometric, Hardware Token และ Risk-Based Authentication ช่วยลดโอกาสที่ Deepfake จะถูกใช้เพื่อเข้าถึงบัญชีหรือระบบสำคัญ

การตั้งคำถาม

Deepfake มักมาพร้อมความเร่งด่วน เช่น “ต้องโอนทันที” หรือ “ห้ามบอกใคร” วิธีป้องกันพื้นฐานคือการตั้งคำถามย้อนกลับ เช่น ขอข้อมูลเฉพาะที่รู้กันภายใน, โทรกลับผ่านหมายเลขทางการ, ตรวจสอบผ่านช่องทางอื่น ด้วยการชะลอการตัดสินใจเพียงไม่กี่นาที สามารถลดความเสียหายได้อย่างมาก

ใช้ซอฟต์แวร์และเครื่องมือป้องกันภัย

แม้ปัจจุบันการทำ Ai Deepfake Detection คือ การวิเคราะห์วิดีโอเชิงลึกจะยังเป็นเทคโนโลยีเฉพาะทาง แต่สิ่งที่องค์กรควรทำคือป้องกัน “ผลกระทบ” จาก Deepfake ผ่านระบบควบคุมการเข้าถึงและการตรวจจับพฤติกรรมผิดปกติ

โซลูชันแนะนำจาก ManageEngine สามารถช่วยเสริมความปลอดภัยได้

- ADSelfService Plus

ADSelfService Plus เป็นโซลูชันด้าน Identity Security ที่ช่วยเสริมความปลอดภัยของบัญชีผู้ใช้งานภายในองค์กร โดยเฉพาะในกรณีที่ผู้โจมตีใช้ Deepfake Ai หรือเทคนิค Social Engineering เพื่อหลอกขอรหัสผ่านหรือรหัส OTP ระบบรองรับ Multi-Factor Authentication (MFA) ซึ่งกำหนดให้ผู้ใช้ยืนยันตัวตนมากกว่าหนึ่งปัจจัย เช่น รหัสผ่านร่วมกับ OTP, Biometric หรือ Push Notification ทำให้แม้รหัสผ่านจะถูกหลอกขอไป ผู้โจมตีก็ยังไม่สามารถเข้าถึงระบบได้ นอกจากนี้ยังมี Adaptive Authentication ที่ประเมินความเสี่ยงตามบริบทการเข้าสู่ระบบ เช่น ตำแหน่งที่ตั้ง อุปกรณ์ หรือพฤติกรรมการใช้งาน หากพบความผิดปกติ ระบบจะเพิ่มขั้นตอนยืนยันตัวตนอัตโนมัติ ช่วยลดความเสี่ยงจากการปลอมตัวผ่าน Ai Deepfake Video หรือเสียงเลียนแบบ และเสริมความแข็งแกร่งให้กับกระบวนการป้องกันการเข้าถึงบัญชีโดยไม่ได้รับอนุญาตอย่างเป็นระบบ สามารถทดลองใช้ ADSelfservice Plus 30 วัน ได้ที่นี่ Log360

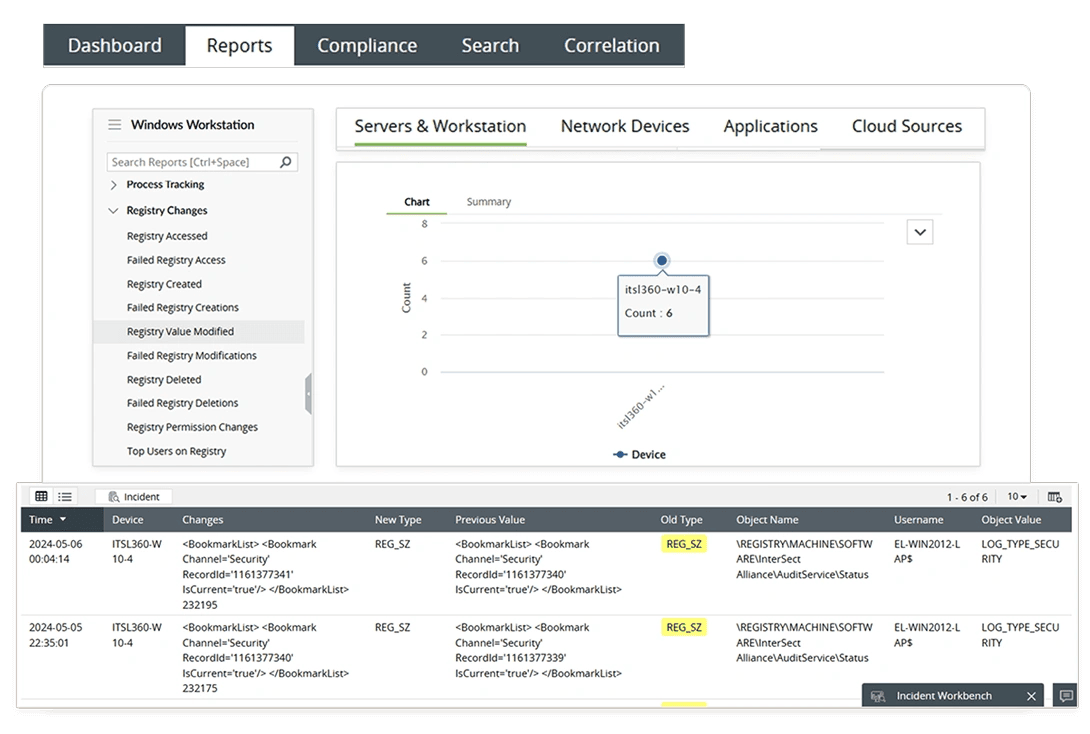

แพลตฟอร์มด้าน Security Information And Event Management ที่ช่วยรวบรวมและวิเคราะห์ Log จากระบบต่าง ๆ ภายในองค์กรแบบรวมศูนย์ ไม่ว่าจะเป็น Active Directory, Server, Firewall หรือ Application สำคัญ เมื่อเกิดเหตุการณ์ต้องสงสัย เช่น การเข้าสู่ระบบจากตำแหน่งที่ไม่คุ้นเคย การพยายามยกระดับสิทธิ์ หรือการเข้าถึงข้อมูลผิดปกติ ระบบสามารถตรวจจับความเสี่ยงแบบ Real-Time และแจ้งเตือนทันที ในกรณีที่ผู้โจมตีใช้ Deepfake Ai หรือเทคนิค Social Engineering หลอกให้พนักงานให้สิทธิ์เข้าถึงบัญชีไปแล้ว Log360 จะทำหน้าที่เป็นกลไกเฝ้าระวังชั้นถัดไป โดยวิเคราะห์พฤติกรรม (Behavioral Analytics) เพื่อระบุความผิดปกติหลังการเข้าสู่ระบบ เช่น การดาวน์โหลดข้อมูลจำนวนมาก หรือการเข้าถึงทรัพยากรที่ไม่สอดคล้องกับบทบาทงาน ช่วยให้องค์กรสามารถจำกัดความเสียหายและตอบสนองต่อเหตุการณ์ได้อย่างรวดเร็ว แม้การหลอกลวงจะเกิดขึ้นแล้วก็ตาม สามารถทดลองใช้ Log360 ฟรี 30วัน ได้ที่นี่

References :

- Thai PBS Verify – “คลิปอ้าง ‘เท้ง ณัฐพงษ์’ ยืนแถลงเรื่อง สส.พรรคประชาชนซื้อเสียง แท้จริงเป็นคลิปสร้างจาก AI-Deepfake” (กฤติมา คลังมนตรี, 8 Feb 2026)

- Thai PBS Verify – “AI Clone & Deepfake ระวังมุกใหม่ ปี 69 เมื่อเสียงและหน้าของคนในครอบครัวอาจไม่ใช่ตัวจริง” (Thai PBS Verify, 2 Jan 2569)

- 1-to-all – “Deepfake ปล้น KYC ไทย! ภัย AI มาเร็ว แต่ Cybersecurity กลับตามไม่ทัน” (Alex Alun, 12 Nov 2025)

ติดตามข่าวสารเพิ่มเติมได้ที่

Linkedin : https://www.linkedin.com/company/manageenginethailand

Facebook: https://www.facebook.com/manageenginethailand