AI Hacking ความเสี่ยงใหม่ต่อองค์กรของคุณ

ในยุคที่ AI กลายเป็นเครื่องมือสำคัญในการขับเคลื่อนธุรกิจ เทคโนโลยีเดียวกันนี้กลับถูกอาชญากรไซเบอร์นำไปใช้เป็นอาวุธที่ทรงพลังภายใต้ปรากฏการณ์ที่เรียกว่า AI Hacking ซึ่งกำลังเปลี่ยนภูมิทัศน์ของ Cybersecurity อย่างมีนัยสำคัญ จากเดิมที่การโจมตีต้องอาศัยทักษะเฉพาะบุคคลและขั้นตอนที่ซับซ้อน ปัจจุบัน Ai Hackers สามารถใช้ Machine Learning วิเคราะห์ช่องโหว่ของระบบแบบอัตโนมัติ ปรับเปลี่ยนรูปแบบการโจมตีแบบ Real-Time และหลบเลี่ยงการตรวจจับของระบบความปลอดภัยได้อย่างชาญฉลาด ขณะเดียวกัน Ai Scammer ก็ใช้ AI สร้างข้อความ Phishing ที่มีความเป็นธรรมชาติ สร้างเสียงปลอมเลียนแบบผู้บริหาร หรือผลิตวิดีโอ Deepfake ที่ดูน่าเชื่อถือจนเหยื่อแทบไม่สามารถแยกแยะได้ ความน่ากังวลคือเทคโนโลยีเหล่านี้ช่วยลดต้นทุนของผู้โจมตี แต่เพิ่มความแม่นยำและขยายขอบเขตการโจมตีได้ในระดับอุตสาหกรรม ส่งผลให้องค์กรทุกขนาด ตั้งแต่ภาคการเงิน ภาครัฐ ไปจนถึงธุรกิจขนาดกลางและขนาดย่อม ตกอยู่ในความเสี่ยงที่ซับซ้อนมากขึ้น การทำความเข้าใจแนวโน้มของ AI Hacking จึงไม่ใช่เพียงการรับรู้ภัยคุกคาม แต่เป็นการเตรียมกลยุทธ์เชิงรุกเพื่อปกป้องข้อมูล ทรัพย์สินดิจิทัล และความน่าเชื่อถือขององค์กรในระยะยาว

สถิติการโจมตีทางไซเบอร์ด้วย AI

ในปี 2024 ถึง 2025 ความเสี่ยงจาก AI Hacking กำลังเติบโตอย่างรวดเร็วและส่งผลกระทบต่อองค์กรทั่วโลก มากกว่าแค่แนวโน้มธรรมดา ข้อมูลจากหลายแหล่งชี้ให้เห็นว่า AI ไม่เพียงช่วยเพิ่มประสิทธิภาพให้ธุรกิจ แต่ถูกนำไปใช้โดยอาชญากรไซเบอร์เพื่อโจมตีระบบอย่างอัตโนมัติและแม่นยำยิ่งขึ้น ตามรายงานของ SoSafe พบว่า 87% ขององค์กรรายงานว่าพบการโจมตีไซเบอร์ที่ขับเคลื่อนด้วย AI ในช่วงปีที่ผ่านมา ซึ่งแสดงให้เห็นว่าภัยคุกคามนี้ไม่ได้เป็นเรื่องไกลตัวอีกต่อไป

นอกจากนี้จากรายงาน Trend Micro State of AI Security 1H 2025 ระบุว่า 93% ของผู้นำด้านความปลอดภัยคาดว่าจะพบการโจมตีด้วย AI ทุกวันในปี 2025 แสดงให้เห็นว่าผู้โจมตีเริ่มใช้ AI เพื่อทำให้การโจมตีเป็นเรื่องปกติและมีความต่อเนื่องมากขึ้น และจากแนวโน้มเชิงสถิติทั่วโลกพบว่าจำนวนการโจมตีทางไซเบอร์เฉลี่ยต่อองค์กรมีการเพิ่มขึ้นอย่างต่อเนื่องตลอดสี่ปีที่ผ่านมา โดยเฉลี่ยสูงขึ้นกว่า 58% ในการโจมตีรายสัปดาห์ ข้อมูลนี้สะท้อนว่าความซับซ้อนของภัยคุกคามที่รวมการใช้ AI เพื่อโจมตีระบบมีแนวโน้มเพิ่มขึ้นอย่างชัดเจน ไม่เพียงตัวเลขของเหตุการณ์เท่านั้น การใช้งาน AI ในการโจมตียังเปลี่ยนจากการเป็น “เครื่องมือช่วย” ไปสู่การเป็นระบบที่สามารถดำเนินการโจมตีแบบอัตโนมัติเต็มรูปแบบ (Autonomous AI agents) ซึ่งเป็นสิ่งที่รายงานข่าวล่าสุดระบุว่า AI จะสามารถโจมตีระบบได้เร็วกว่าการป้องกันแบบมนุษย์เดิมอย่างชัดเจนในปี 2026

ดังนั้นเทรนด์ของ AI Hacking ในบริบทของ Cybersecurity ไม่ได้เป็นเพียงแค่สิ่งใหม่ที่คาดเดาได้เท่านั้น แต่กำลังกลายเป็นหนึ่งในปัจจัยหลักที่เพิ่มทั้งความถี่ ความรุนแรง และรูปแบบของการโจมตีทางไซเบอร์อย่างต่อเนื่องในระดับองค์กรและทั่วโลก ทำให้การรับมือและสร้างระบบป้องกันที่คำนึงถึง AI Attack เป็นสิ่งจำเป็นมากขึ้นในยุคดิจิทัลนี้

การโจมตีทางไซเบอร์ด้วย AI คืออะไร?

การโจมตีทางไซเบอร์ด้วย AI คือรูปแบบของอาชญากรรมดิจิทัลที่นำเทคโนโลยีปัญญาประดิษฐ์มาใช้เพื่อเพิ่มความสามารถในการเจาะระบบ หลอกลวง หรือสร้างความเสียหายต่อองค์กรในระดับที่รวดเร็วและแม่นยำมากขึ้น แนวคิดของ AI Hacking จึงไม่ใช่เพียงการใช้โปรแกรมอัตโนมัติทั่วไป แต่เป็นการใช้ AI เพื่อทำให้การโจมตีมีความ “ฉลาด” สามารถวิเคราะห์ข้อมูลจำนวนมาก เรียนรู้รูปแบบ และปรับตัวตามสภาพแวดล้อมได้ ต่างจากการโจมตีแบบดั้งเดิมที่ต้องอาศัยแรงงานและทักษะของมนุษย์เป็นหลัก

ปัจจุบันทั้ง Ai Hacker และ Ai Scammer สามารถใช้ AI เพื่อยกระดับประสิทธิภาพของการโจมตี ไม่ว่าจะเป็นการสร้างเนื้อหาหลอกลวงที่แนบเนียน การปลอมแปลงตัวตน หรือการดำเนินการโจมตีแบบอัตโนมัติในวงกว้าง ส่งผลให้ภัยคุกคามด้าน Cybersecurity มีความซับซ้อนมากขึ้น และยากต่อการตรวจจับด้วยเครื่องมือแบบเดิม ดังนั้น การโจมตีด้วย AI จึงถือเป็นวิวัฒนาการของภัยไซเบอร์ที่องค์กรไม่สามารถมองข้ามได้ในยุคดิจิทัลปัจจุบัน

AI ถูกนำมาใช้ในการโจมตีทางไซเบอร์อย่างไร?

ปัจจุบัน AI ไม่ได้ถูกใช้เพียงเพื่อพัฒนาเครื่องมือป้องกันภัยไซเบอร์เท่านั้น แต่ยังถูกนำมาใช้เป็น “ตัวเร่งความสามารถ” ของผู้โจมตีอย่างมีนัยสำคัญ โดยเฉพาะในบริบทของ AI Hacking ที่ทำให้การโจมตีมีความแม่นยำ อัตโนมัติ และขยายผลได้ในวงกว้างมากขึ้น หนึ่งในรูปแบบที่พบได้บ่อยคือการใช้ AI วิเคราะห์ช่องโหว่ของระบบจากข้อมูลจำนวนมหาศาล เพื่อคัดเลือกเป้าหมายที่มีความเสี่ยงสูง จากนั้นระบบสามารถสร้างรูปแบบการโจมตีที่เหมาะสมโดยอัตโนมัติ ลดการพึ่งพาทักษะของมนุษย์โดยตรง

นอกจากนี้ Ai Hackers ยังใช้ Machine Learning เพื่อปรับเปลี่ยนพฤติกรรมของมัลแวร์ให้สามารถหลบเลี่ยงระบบตรวจจับแบบดั้งเดิม เช่น Signature-Based Detection ได้แบบ Real-Time ขณะที่ Ai Scammer ใช้ Generative AI สร้างอีเมล Phishing ที่มีโครงสร้างภาษาเหมือนมนุษย์ วิเคราะห์ข้อมูลจาก Social Media เพื่อปรับข้อความให้ตรงกับพฤติกรรมของเหยื่อ หรือแม้แต่สร้างเสียงและวิดีโอ Deepfake เพื่อปลอมตัวเป็นผู้บริหารระดับสูงในการหลอกโอนเงิน

อีกหนึ่งมิติสำคัญคือการทำ Automation Attack เช่น การใช้ AI ทำ Password Guessing และ Brute Force ในระดับที่รวดเร็วกว่าเดิมหลายเท่า รวมถึงการสร้าง Botnet อัจฉริยะที่สามารถเรียนรู้จากพฤติกรรมของระบบเป้าหมาย เมื่อผสานกับความสามารถในการวิเคราะห์พฤติกรรมผู้ใช้งาน (Behavioral Analysis) AI จึงทำให้การโจมตีมีลักษณะ “Adaptive” หรือปรับตัวตามสถานการณ์ได้อย่างต่อเนื่อง

กล่าวได้ว่า AI ทำให้การโจมตีทางไซเบอร์เปลี่ยนจากรูปแบบเชิงปฏิบัติการของมนุษย์ ไปสู่ระบบอัตโนมัติที่มีความฉลาด เรียนรู้ และพัฒนาได้เอง ซึ่งเป็นเหตุผลสำคัญที่ทำให้องค์กรต้องยกระดับกลยุทธ์ด้าน Cybersecurity เพื่อรับมือกับภัยคุกคามรูปแบบใหม่ที่ขับเคลื่อนด้วย AI อย่างจริงจัง

ประเภทภัยคุกคามจาก AI

การพัฒนาอย่างก้าวกระโดดของ AI ทำให้รูปแบบการโจมตีทางไซเบอร์เปลี่ยนไปอย่างมีนัยสำคัญ ภัยคุกคามจาก AI Hacking ไม่ได้เป็นเพียงการแฮ็กข้อมูลแบบดั้งเดิม แต่เป็นการโจมตีที่มีความฉลาด อัตโนมัติ และปรับตัวได้เอง ส่งผลให้ทั้งองค์กรขนาดใหญ่และธุรกิจทั่วไปตกอยู่ในความเสี่ยงมากขึ้น เมื่อ AI Hacker และ AI Scammer ใช้ AI เป็นเครื่องมือหลัก ความซับซ้อนและความแนบเนียนของการโจมตีจึงเพิ่มขึ้นอย่างเห็นได้ชัด ต่อไปนี้คือรูปแบบภัยคุกคามสำคัญที่องค์กรควรตระหนัก

การแฮ็กด้วย Deepfake : การใช้ AI สร้างวิดีโอหรือภาพปลอมที่สมจริง เพื่อปลอมตัวเป็นผู้บริหารหรือบุคคลสำคัญในการหลอกโอนเงินหรือเข้าถึงข้อมูลสำคัญ สร้างความเสียหายทั้งด้านการเงินและชื่อเสียงองค์กร

การสร้างมัลแวร์ AI Hacking : AI ถูกนำมาใช้พัฒนา Malware ที่สามารถปรับเปลี่ยนโค้ดหรือพฤติกรรมเพื่อหลบเลี่ยงระบบตรวจจับแบบดั้งเดิม ทำให้การป้องกันทำได้ยากขึ้น

Social Engineering และ AI : AI วิเคราะห์ข้อมูลจาก Social Media และแหล่งข้อมูลสาธารณะ เพื่อสร้างข้อความหลอกลวงที่ตรงกับพฤติกรรมหรือความสนใจของเหยื่อ เพิ่มโอกาสสำเร็จของการโจมตี

การโจมตีแบบ Brute Force ด้วย AI : AI ช่วยเพิ่มความเร็วในการคาดเดารหัสผ่านหรือ Credential ต่าง ๆ ทำให้การเจาะระบบทำได้รวดเร็วและมีประสิทธิภาพมากกว่าการโจมตีแบบเดิม

การโจมตีด้วย Phishing ที่มาจาก AI : Generative AI สามารถสร้างอีเมล Phishing ที่มีภาษาธรรมชาติและบริบทสมจริง ลดจุดสังเกตที่ผู้ใช้เคยใช้ตรวจจับภัยคุกคาม

การเจาะระบบ CAPTCHA ด้วย AI : AI สามารถเรียนรู้และแก้ระบบ CAPTCHA ได้แม่นยำขึ้น ทำให้ระบบป้องกัน Bot แบบพื้นฐานไม่มีประสิทธิภาพเพียงพอ

การลอกเลียนเสียงด้วย AI Hacking : เทคโนโลยี Voice Cloning ช่วยให้ผู้โจมตีปลอมเสียงผู้บริหารหรือพนักงาน เพื่อหลอกให้เกิดการโอนเงินหรือเปิดเผยข้อมูลสำคัญ

การดักข้อมูลผ่าน Keystroke ด้วย AI : AI สามารถวิเคราะห์รูปแบบการพิมพ์ หรือ Keystroke Dynamics เพื่อคาดเดาข้อมูลหรือ Credential ของผู้ใช้งาน เพิ่มความเสี่ยงต่อการรั่วไหลของข้อมูลสำคัญ

ใครคือเป้าของ AI Hacker และ AI Scammer

ในยุคของ AI Hacking การเลือกเป้าหมายไม่ได้อาศัยการสุ่มเหมือนในอดีต แต่ใช้ AI วิเคราะห์ข้อมูล พฤติกรรม และช่องโหว่ของแต่ละองค์กรหรือบุคคล ทำให้ทั้ง Ai Hackers และ Ai Scammer สามารถโจมตีได้แม่นยำและเฉพาะเจาะจงมากขึ้น กลุ่มเป้าหมายจึงขยายกว้างและซับซ้อนกว่าที่เคย โดยกลุ่มเป้าหมายหลักได้แก่

- องค์กรภาคการเงิน : ธนาคาร บริษัทประกัน และ FinTech เป็นเป้าหมายหลัก เนื่องจากมีข้อมูลธุรกรรมและข้อมูลส่วนบุคคลจำนวนมาก

- หน่วยงานภาครัฐ : มีฐานข้อมูลประชาชนจำนวนมหาศาล และเป็นโครงสร้างพื้นฐานสำคัญของประเทศ

- ธุรกิจขนาดกลางและขนาดย่อม (SME) : มักมีงบประมาณด้าน Cybersecurity จำกัด ทำให้เป็นเป้าหมายที่เข้าถึงได้ง่าย

- องค์กรที่อยู่ระหว่าง Digital Transformation : ระบบที่กำลังปรับเปลี่ยนอาจมีช่องโหว่ที่ยังไม่ได้รับการป้องกันครบถ้วน

- ผู้บริหารระดับสูง (Executive Level) : มักถูกปลอมแปลงตัวตนผ่าน Deepfake หรือ Business Email Compromise เพื่อหลอกอนุมัติธุรกรรม

- ฝ่ายการเงินและบัญชี : เป็นจุดสำคัญของการโอนเงิน จึงถูกเล็งเป้าโดย Ai Scammer บ่อยครั้ง

- พนักงานทั่วไปในองค์กร : โดยเฉพาะผู้ที่มีสิทธิ์เข้าถึงระบบสำคัญ หรือมีพฤติกรรมใช้งาน Social Media เปิดเผยข้อมูลมากเกินไป

- ผู้ใช้งานทั่วไป : ข้อมูลจาก Social Media สามารถถูกนำไปวิเคราะห์เพื่อสร้าง Phishing หรือการหลอกลวงแบบเฉพาะบุคคลได้อย่างแม่นยำ

ดังนั้นในยุคที่ AI ขับเคลื่อนภัยไซเบอร์ “ทุกองค์กรและทุกคน” มีโอกาสตกเป็นเป้าหมาย หากไม่มีมาตรการป้องกันที่รัดกุมและทันสมัย

วิธีการรับมือเมื่อตกเป็นเหยื่อของ AI Hacking

แยกและควบคุมความเสียหายทันที (Containment)

เมื่อสงสัยว่าตกเป็นเหยื่อของ AI Hacking สิ่งสำคัญที่สุดคือการจำกัดขอบเขตความเสียหายโดยเร็ว ควรตัดการเชื่อมต่ออุปกรณ์ที่อาจถูกโจมตีออกจากเครือข่าย เปลี่ยนรหัสผ่านที่เกี่ยวข้อง และระงับสิทธิ์การเข้าถึงที่มีความเสี่ยง การดำเนินการอย่างรวดเร็วช่วยลดโอกาสที่ผู้โจมตีจะขยายผลหรือเข้าถึงระบบเพิ่มเติม

ตรวจสอบ วิเคราะห์ และเก็บหลักฐาน (Investigation)

องค์กรควรดำเนินการตรวจสอบ Log การใช้งาน ระบบ Endpoint และพฤติกรรมที่ผิดปกติ เพื่อประเมินว่าการโจมตีเกิดขึ้นอย่างไร และมีข้อมูลใดได้รับผลกระทบบ้าง การเก็บหลักฐานอย่างเป็นระบบมีความสำคัญทั้งในเชิงกฎหมายและการปรับปรุงมาตรการป้องกันในอนาคต โดยเฉพาะกรณีที่เกี่ยวข้องกับ Ai Hacker หรือ Ai Scammer ที่ใช้เทคนิคซับซ้อน

แจ้งเตือนผู้เกี่ยวข้องและปฏิบัติตามข้อกำหนดทางกฎหมาย

หากพบว่ามีการรั่วไหลของข้อมูลส่วนบุคคล ควรแจ้งหน่วยงานกำกับดูแลและผู้ได้รับผลกระทบตามข้อกำหนดของกฎหมาย เช่น PDPA การสื่อสารอย่างโปร่งใสช่วยลดผลกระทบด้านความเชื่อมั่นและแสดงถึงความรับผิดชอบขององค์กร

เสริมความแข็งแกร่งของระบบ Cybersecurity

หลังจากควบคุมเหตุการณ์ได้แล้ว องค์กรควรทบทวนมาตรการป้องกัน เช่น การใช้ Multi-Factor Authentication การอัปเดตระบบอย่างสม่ำเสมอ และการติดตั้งระบบตรวจจับภัยคุกคามที่สามารถวิเคราะห์พฤติกรรมเชิงลึกได้ การยกระดับ Cybersecurity ให้ทันต่อภัยจาก AI ถือเป็นการลดความเสี่ยงในระยะยาว

อบรมพนักงานและสร้างความตระหนักรู้

เนื่องจากหลายเหตุการณ์มีองค์ประกอบของ Human Error การให้ความรู้พนักงานเกี่ยวกับ Phishing, Deepfake และ Social Engineering จึงเป็นสิ่งสำคัญ เพราะแม้เทคโนโลยีจะซับซ้อนเพียงใด หากบุคลากรมีความตระหนักรู้ ก็สามารถลดโอกาสสำเร็จของการโจมตีได้อย่างมีนัยสำคัญ

ตัวอย่างเหตุการณ์ภัยคุกคามและกลโกงที่เกิดจาก AI

กรณีบริษัทวิศวกรรมระดับโลก ถูกหลอกจากวิดีโอที่สร้างจาก AI หรือ Deepfake Video

ในช่วงต้นปี 2024 บริษัทวิศวกรรมระดับโลก Arup ซึ่งมีสำนักงานในหลายประเทศ ตกเป็นเหยื่อของการฉ้อโกงที่ใช้ AI ขั้นสูงในการปลอมแปลงตัวตน เหตุการณ์เกิดขึ้นเมื่อพนักงานฝ่ายการเงินประจำสำนักงานฮ่องกงได้รับคำเชิญเข้าร่วมการประชุมวิดีโอคอลกับผู้บริหารระดับสูงของบริษัท ในการประชุมดังกล่าว ผู้เข้าร่วมหลายคนดูเหมือนเป็นผู้บริหารจริง ทั้งภาพ เสียง และท่าทางการพูดถูกสร้างขึ้นด้วยเทคโนโลยี Deepfake ที่ขับเคลื่อนด้วย AI

ระหว่างการประชุม มีการสั่งการให้ดำเนินธุรกรรมทางการเงินที่อ้างว่าเป็น “ดีลลับ” ของบริษัท พนักงานซึ่งเชื่อว่าเป็นคำสั่งจากผู้บริหารตัวจริง จึงทำการโอนเงินรวมมูลค่ากว่า 25 ล้านดอลลาร์สหรัฐไปยังบัญชีปลายทางหลายบัญชี ก่อนที่จะพบภายหลังว่าเป็นการหลอกลวงทั้งหมด โดยผู้โจมตีใช้ AI เพื่อสร้างทั้งวิดีโอและเสียงที่สมจริงจนแทบไม่สามารถแยกแยะได้

เหตุการณ์นี้ถูกเปิดเผยผ่านสื่อระดับสากล และกลายเป็นหนึ่งในกรณีตัวอย่างสำคัญของ AI Hacking ที่ใช้ Social Engineering ผสานกับ Deepfake เพื่อสร้างความน่าเชื่อถือในระดับองค์กร ภายหลังเหตุการณ์ Arup ได้ดำเนินมาตรการเร่งด่วน ได้แก่ การเพิ่มขั้นตอนการยืนยันตัวตนหลายชั้น (Multi-Factor Authentication) สำหรับการอนุมัติธุรกรรมมูลค่าสูง การบังคับใช้หลักการอนุมัติร่วม (Dual Authorization) และการกำหนดให้มีการยืนยันคำสั่งผ่านช่องทางแยกต่างหาก (Out-of-Band Verification) นอกจากนี้ยังมีการจัดอบรมพนักงานทั่วโลกเกี่ยวกับความเสี่ยงจาก Deepfake และ AI Scam เพื่อเสริมสร้างความตระหนักรู้ด้าน Cybersecurity

กรณีของ Arup แสดงให้เห็นชัดเจนว่า AI ไม่ได้เพียงช่วยเพิ่มประสิทธิภาพการทำงานในองค์กร แต่สามารถถูกใช้เป็นเครื่องมือในการปลอมแปลงตัวตนระดับสูง และสร้างความเสียหายทางการเงินมหาศาลได้ภายในระยะเวลาอันสั้น หากองค์กรไม่มีมาตรการควบคุมที่รัดกุมเพียงพอ

เหตุการณ์การสร้างโฆษณาจาก AI เพื่อใช้ในการหลอกลวงใน Search Engine ชื่อดัง

ในช่วงปี 2023 ถึง 2024 Google เปิดเผยผ่าน Google Ads Safety Report 2024 ว่าพบการเพิ่มขึ้นอย่างมีนัยสำคัญของโฆษณาหลอกลวงที่ใช้ AI สร้างเนื้อหาและภาพปลอม โดยเฉพาะโฆษณาที่เลียนแบบบุคคลมีชื่อเสียง เช่น นักธุรกิจ นักลงทุน หรือผู้บริหารบริษัทเทคโนโลยี เพื่อชักชวนให้ประชาชนลงทุนในแพลตฟอร์มปลอมหรือโครงการคริปโตที่ไม่มีอยู่จริง

กลโกงลักษณะนี้มักใช้ Generative AI สร้างภาพ Deepfake หรือข้อความโฆษณาที่ดูน่าเชื่อถือ พร้อมใส่คำพูดปลอมราวกับเป็นคำแนะนำการลงทุนจากบุคคลดัง เมื่อผู้ใช้งานค้นหาชื่อบุคคลหรือคำที่เกี่ยวข้องกับการลงทุน โฆษณาปลอมเหล่านี้จะปรากฏในตำแหน่งที่โดดเด่น ทำให้เหยื่อเข้าใจผิดว่าเป็นโฆษณาที่ผ่านการรับรองแล้ว

Google รายงานว่าในปี 2024 บริษัทได้ลบโฆษณาที่ละเมิดนโยบายมากกว่าหลายพันล้านรายการ และระงับบัญชีผู้ลงโฆษณาหลายล้านบัญชีที่เกี่ยวข้องกับการฉ้อโกง รวมถึงเพิ่มการใช้ AI ภายในเพื่อตรวจจับพฤติกรรมต้องสงสัยแบบอัตโนมัติ บริษัทได้ขยายมาตรการ Advertiser Verification Program ให้ครอบคลุมมากขึ้น โดยกำหนดให้ผู้ลงโฆษณาต้องยืนยันตัวตน เอกสารบริษัท และแหล่งที่มาของธุรกิจอย่างชัดเจน ก่อนสามารถเผยแพร่โฆษณาได้

นอกจากนี้ Google ยังพัฒนาโมเดล AI เพื่อวิเคราะห์รูปแบบข้อความ ภาพ และพฤติกรรมการลงโฆษณาที่ผิดปกติ รวมถึงใช้ระบบ Machine Learning เพื่อตรวจจับเครือข่ายบัญชีที่เกี่ยวข้องกับการหลอกลวงในลักษณะเป็นกลุ่ม (Coordinated Scam Network) และลบออกก่อนที่จะสร้างความเสียหายเป็นวงกว้าง

กรณีนี้สะท้อนให้เห็นว่า AI ไม่ได้ถูกใช้เพียงเพื่อโจมตีระบบโดยตรง แต่ยังถูกใช้สร้าง “ภาพลวงตา” บนแพลตฟอร์มที่ผู้คนไว้วางใจอย่าง Search Engine ซึ่งเพิ่มความแนบเนียนและขยายขอบเขตของ AI Scam ไปสู่ประชาชนทั่วไปในวงกว้าง หากไม่มีระบบตรวจจับและกระบวนการตรวจสอบผู้ลงโฆษณาที่เข้มงวด ความเสียหายทางการเงินและความเชื่อมั่นอาจเพิ่มขึ้นอย่างรวดเร็ว

เหตุการณ์ข้อมูลรั่วไหลของบริษัทด้านสุขภาพในสหรัฐฯ

ในปี 2024 มีรายงานจาก HIPAA Journal เกี่ยวกับเหตุการณ์ Data Breach ที่เกิดขึ้นกับบริษัทเทคโนโลยีด้านสุขภาพในสหรัฐอเมริกา ซึ่งให้บริการแพลตฟอร์มจัดการข้อมูลผู้ป่วยและระบบเวชระเบียนอิเล็กทรอนิกส์ (Electronic Health Records – EHR) ผู้โจมตีสามารถเข้าถึงข้อมูลสำคัญของผู้ป่วย เช่น ชื่อ-นามสกุล หมายเลขประกันสุขภาพ วันเกิด และข้อมูลทางการแพทย์บางส่วน โดยไม่ได้รับอนุญาต

รายงานระบุว่า ผู้โจมตีใช้เทคนิค Automation ผสานกับ AI เพื่อวิเคราะห์ช่องโหว่ของระบบและคัดเลือกจุดที่มีความเสี่ยงสูง ทำให้การเจาะระบบมีความแม่นยำและรวดเร็วกว่าการโจมตีแบบเดิม นอกจากนี้ยังมีการใช้เครื่องมืออัตโนมัติเพื่อเคลื่อนที่ภายในเครือข่าย (Lateral Movement) และพยายามขยายขอบเขตการเข้าถึงข้อมูลก่อนถูกตรวจพบ

หลังจากตรวจพบเหตุการณ์ บริษัทได้ดำเนินการปิดกั้นการเข้าถึงที่ผิดปกติทันที และว่าจ้างผู้เชี่ยวชาญด้าน Digital Forensics เพื่อสอบสวนต้นตอของการโจมตี พร้อมทั้งเสริมมาตรการด้าน Cybersecurity อย่างเร่งด่วน ได้แก่ การติดตั้งและปรับปรุงระบบ Endpoint Detection And Response (EDR) เพื่อเฝ้าระวังพฤติกรรมผิดปกติในอุปกรณ์ปลายทาง การทำ Network Segmentation เพื่อลดความสามารถในการเคลื่อนที่ของผู้โจมตีภายในระบบ และการบังคับใช้ Multi-Factor Authentication กับบัญชีที่มีสิทธิ์ระดับสูง

ตามข้อกำหนดของกฎหมาย HIPAA บริษัทได้แจ้งผู้ได้รับผลกระทบและหน่วยงานกำกับดูแลที่เกี่ยวข้อง พร้อมให้บริการติดตามเครดิต (Credit Monitoring) แก่ผู้ป่วยที่ได้รับผลกระทบ เพื่อบรรเทาความเสียหายที่อาจเกิดขึ้นในอนาคต

กรณีนี้สะท้อนให้เห็นว่า เมื่อ AI ถูกนำมาใช้วิเคราะห์ช่องโหว่และเพิ่มประสิทธิภาพการโจมตี ผลกระทบอาจขยายวงกว้างอย่างรวดเร็ว โดยเฉพาะในอุตสาหกรรมด้านสุขภาพซึ่งถือครองข้อมูลที่มีความอ่อนไหวสูง จึงยิ่งตอกย้ำความจำเป็นของการยกระดับมาตรการ Cybersecurity ให้ทันต่อภัยคุกคามที่ขับเคลื่อนด้วย AI

เหตุการณ์เหล่านี้แสดงให้เห็นว่า AI ไม่ได้เป็นเพียงเครื่องมือช่วยพัฒนาธุรกิจ แต่ยังถูกใช้เพื่อยกระดับรูปแบบการโจมตีในระดับองค์กร บริษัทที่สามารถรับมือได้อย่างมีประสิทธิภาพล้วนยกระดับมาตรการ Cybersecurity ให้สอดคล้องกับภัยคุกคามที่ขับเคลื่อนด้วย AI อย่างต่อเนื่อง

โซลูชั่นแนะนำ

ในยุคที่ภัยคุกคามจาก AI Hacking มีความซับซ้อนและฉลาดขึ้นแบบก้าวกระโดด การใช้โซลูชั่นสำหรับ Cybersecurity เชิงรุก จะช่วยให้องค์กรจัดการความเสี่ยงได้อย่างเป็นระบบมากขึ้น ด้านล่างนี้คือชุดโซลูชั่นที่ ManageEngine แนะนำเพื่อเสริมเกราะป้องกันและลดผลกระทบจากการโจมตีที่ขับเคลื่อนด้วย AI

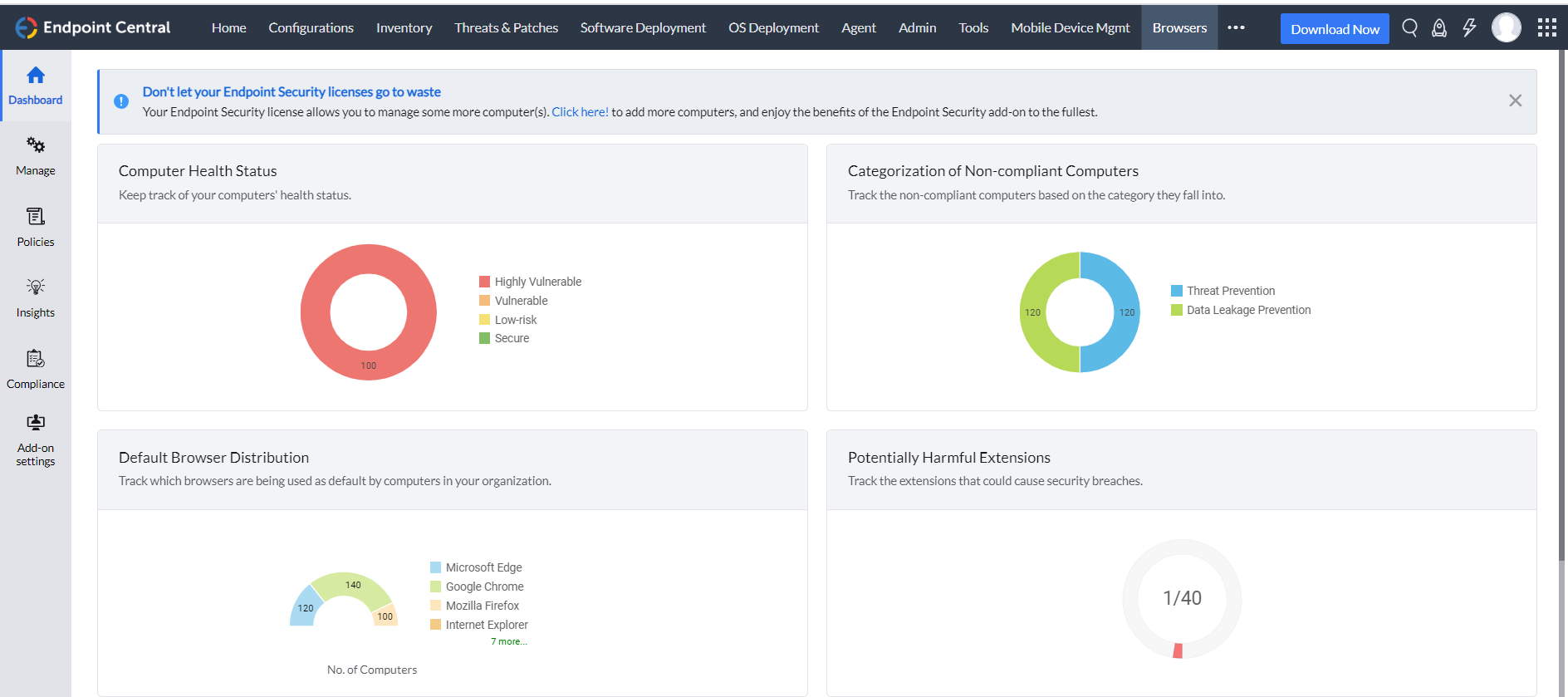

- Endpoint Central ป้องกันอุปกรณ์ปลายทางอย่างครอบคลุม

อุปกรณ์ปลายทาง เช่น โน้ตบุ๊ก เซิร์ฟเวอร์ และอุปกรณ์พกพา ถือเป็นจุดเริ่มต้นหลักของการโจมตีในยุค AI Hacking เพราะเป็นช่องทางที่ผู้โจมตีสามารถฝังมัลแวร์หรือขโมยข้อมูลรับรองตัวตนได้ง่าย Endpoint Central จาก ManageEngine ช่วยให้องค์กรสามารถติดตั้งและจัดการ Endpoint Protection แบบรวมศูนย์ ควบคุมการใช้งานแอปพลิเคชันผ่านระบบ Application Control และกำหนดนโยบายความปลอดภัยได้อย่างเป็นระบบ พร้อมความสามารถในการตรวจจับพฤติกรรมผิดปกติที่อาจเป็นสัญญาณของ AI-Assisted Malware หรือการโจมตีแบบ Automation ที่พยายามหลบเลี่ยงระบบป้องกันแบบเดิม ผลลัพธ์คือองค์กรสามารถลดความเสี่ยงจากมัลแวร์ขั้นสูงและป้องกันการลุกลามของภัยคุกคามได้ตั้งแต่ต้นทาง สนใจทดลองปกป้องอุปกรณ์ของคุณ 30 วันได้ที่นี่

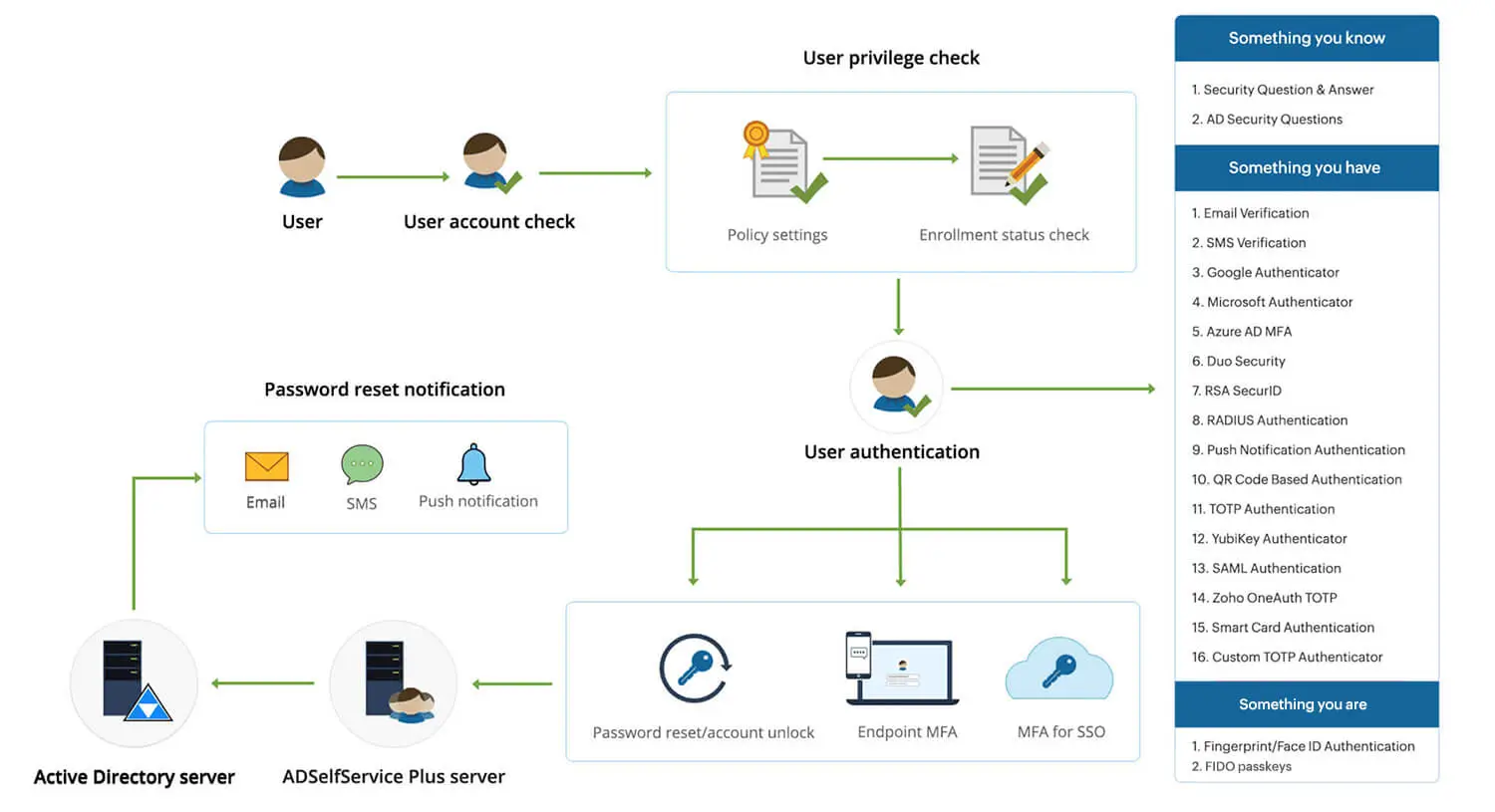

- ADSelfService Plus ยกระดับการยืนยันตัวตนและ MFA

การโจมตีรูปแบบ Brute Force หรือ Credential Stuffing มักเริ่มจากการเข้าถึงชื่อผู้ใช้และรหัสผ่านที่รั่วไหล ADSelfService Plus ช่วยเสริมความแข็งแกร่งด้าน Identity Security ด้วยการเพิ่ม Multi-Factor Authentication (MFA) สำหรับการล็อกอินทั้งภายในและภายนอกองค์กร รวมถึงระบบ Self-Service Password Reset ที่ช่วยให้ผู้ใช้งานจัดการรหัสผ่านได้อย่างปลอดภัย ลดภาระของฝ่าย IT และลดโอกาสการใช้รหัสผ่านซ้ำ นอกจากนี้ การยืนยันตัวตนหลายชั้นยังช่วยป้องกันการเข้าถึงโดยไม่ได้รับอนุญาต แม้ผู้โจมตีจะใช้ AI เพื่อคาดเดาหรือขโมยรหัสผ่านได้ก็ตาม ทำให้องค์กรสามารถปกป้องข้อมูลสำคัญและลดความเสี่ยงจากการถูกยึดบัญชีผู้ใช้ได้อย่างมีประสิทธิภาพ ทดลองปกป้องข้อมูลของคุณให้ปลอดภัยด้วยเดโม่ 30 วันที่นี่

คำถามที่พบบ่อย

AI ในอาชญากรรมไซเบอร์หมายถึงการนำเทคโนโลยีปัญญาประดิษฐ์มาใช้เพื่อเพิ่มประสิทธิภาพในการโจมตีระบบ หลอกลวง หรือขโมยข้อมูล โดยทำให้การโจมตีมีความรวดเร็ว แม่นยำ และปรับตัวได้เองมากขึ้น แตกต่างจากการโจมตีแบบดั้งเดิมที่อาศัยแรงงานมนุษย์เป็นหลัก ปัจจุบัน AI กลายเป็นเครื่องมือสำคัญของอาชญากรไซเบอร์ในการวิเคราะห์ช่องโหว่และเลือกเป้าหมายอย่างมีประสิทธิภาพ

AI Attacks คืออะไร?

AI Attacks คือการโจมตีทางไซเบอร์ที่ใช้ AI เป็นตัวช่วยในการวางแผนหรือดำเนินการโจมตี เช่น การสร้าง Phishing Email ที่แนบเนียน การปลอมแปลงเสียงหรือวิดีโอด้วย Deepfake หรือการใช้ระบบอัตโนมัติในการสแกนหาช่องโหว่ในเครือข่าย จุดเด่นของ AI Attack คือความสามารถในการทำงานแบบอัตโนมัติและขยายผลในวงกว้าง

แฮ็กเกอร์ใช้ AI ยังไง

แฮ็กเกอร์ใช้ AI เพื่อวิเคราะห์ข้อมูลจำนวนมาก ค้นหาจุดอ่อนของระบบ และพัฒนาการโจมตีให้ซับซ้อนขึ้น เช่น การปรับพฤติกรรมมัลแวร์ให้หลบเลี่ยงระบบตรวจจับ หรือการคาดเดารหัสผ่านด้วยความเร็วสูงกว่าเดิมหลายเท่า AI ช่วยลดต้นทุนของผู้โจมตีและเพิ่มโอกาสความสำเร็จของการเจาะระบบ

References

SoSafe Awareness – “Global businesses face escalating AI risk, as 87% hit by AI cyberattacks” (SoSafe press release, 6 March 2025)

Trend Micro – “Trend Micro State of AI Security Report, 1H 2025” (Trend Micro, 29 July 2025)

World Economic Forum – “Cybersecurity awareness: AI threats and cybercrime in 2025” (World Economic Forum, published Sep 2025)

Spring News – “ภัยร้ายปี 2026 ยุคอาชญากรรมไซเบอร์ 100% AI โจมตีเร็วระดับนาที” (Spring News, 26 August 2025)

The Guardian – “UK engineering firm Arup falls victim to £20m deepfake scam” (The Guardian, 17 May 2024)

Financial Times – “Arup deepfake scam” (Financial Times, May 2024) — full article behind paywall (subscription required)

Google – “Our 2024 Ads Safety Report shows how we use AI to safeguard consumers” (Google Company Blog, 2024)

Google Ads Safety Report 2024 (PDF) – “Ads safety report 2024” (Google, 2024)

HIPAA Journal – “Healthcare Data Breach Statistics” (HIPAA Journal, updated 2024)

ติดตามข่าวสารเพิ่มเติมได้ที่

Linkedin : https://www.linkedin.com/company/manageenginethailand

Facebook: https://www.facebook.com/manageenginethailand