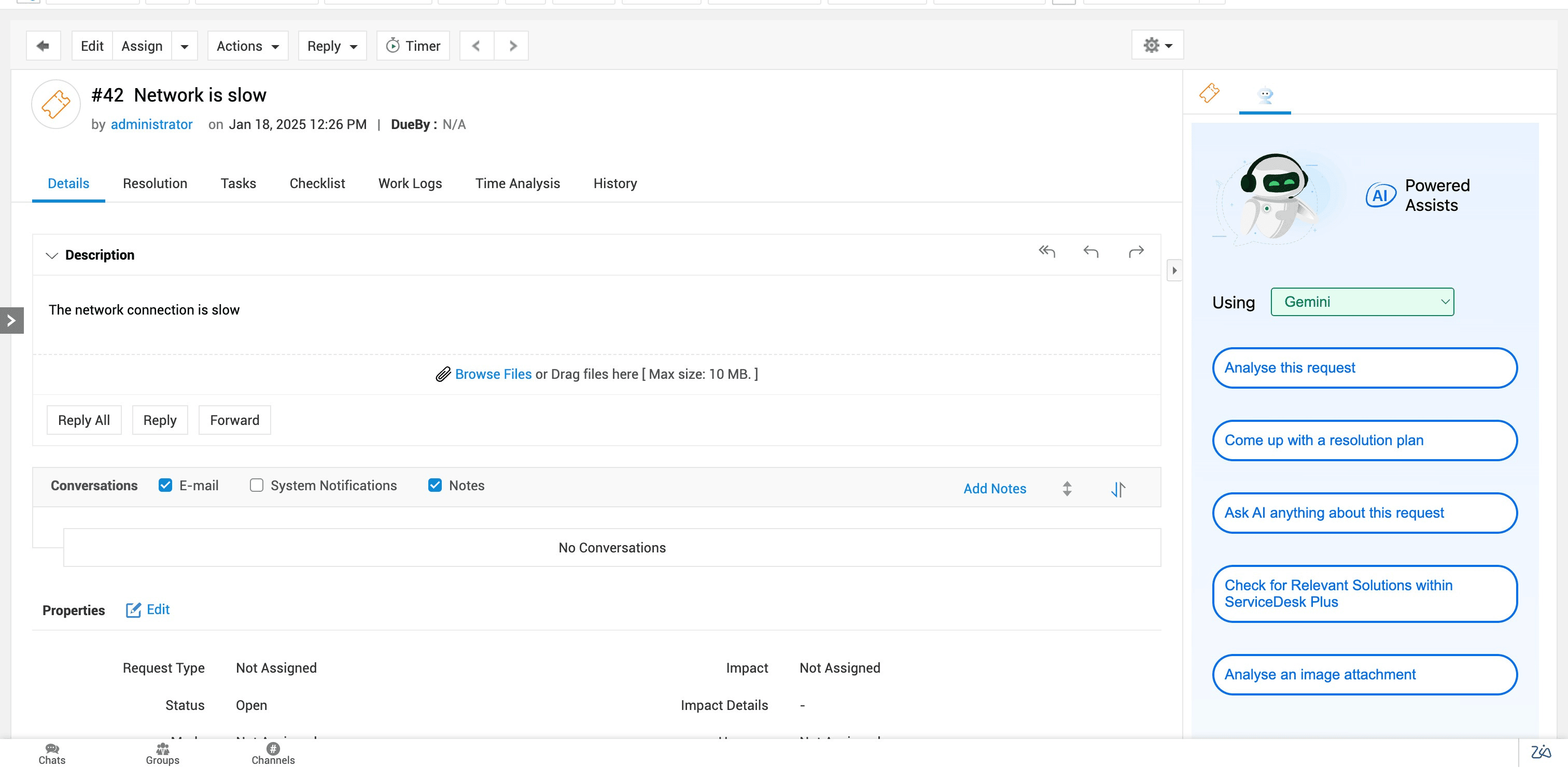

Widget personalizado del Asistente de IA

El widget personalizado del Asistente de IA está diseñado para mejorar el flujo de trabajo de análisis de solicitudes mediante el poder de múltiples proveedores de IA.

Actualmente, el widget admite tres proveedores de IA:

Gemini de Google (en línea)

GPT-4 de OpenAI (en línea)

Ollama (LLM locales)

Aspectos destacados de las funciones

El widget personalizado del Asistente de IA en ServiceDesk Plus le ofrece los siguientes beneficios:

Análisis detallado de solicitudes

Plan de resolución estructurado

Pregunte cualquier cosa sobre una solicitud (Ask AI)

Análisis preciso de imágenes (solo Gemini)

Mostrar soluciones relevantes dentro de ServiceDesk Plus (solo Gemini)

Revisión posterior al incidente optimizada (PIR)

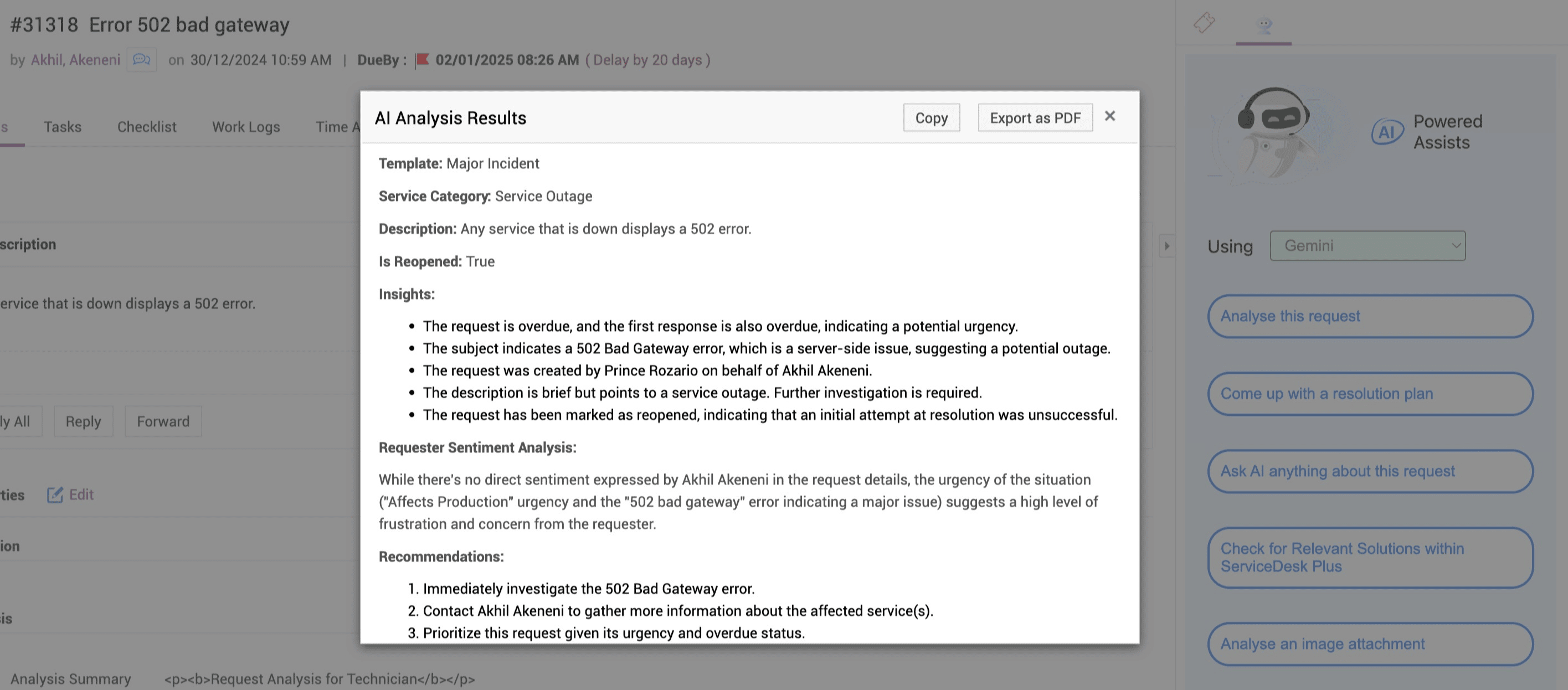

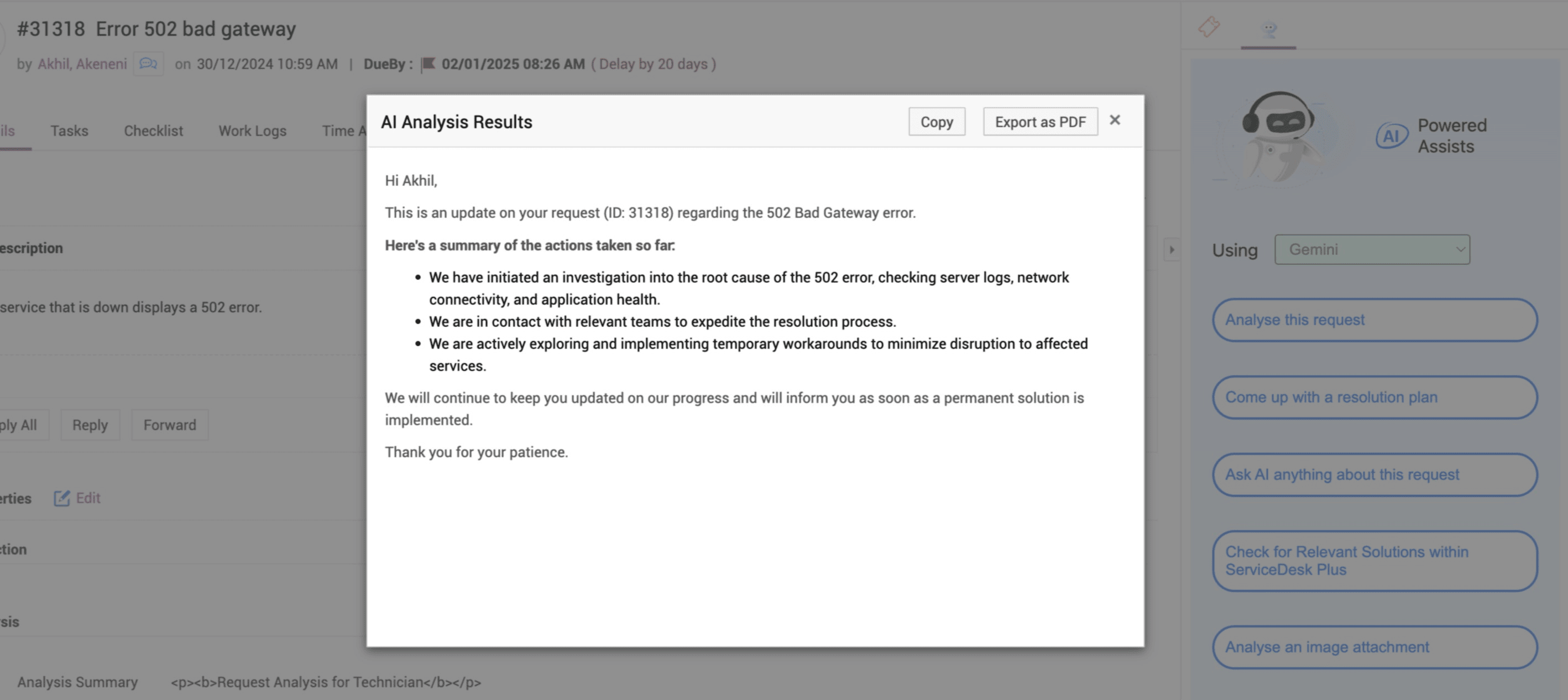

Análisis detallado de solicitudes

Analiza los detalles de la solicitud actual, incluido el sentimiento del solicitante, y proporciona un desglose integral de los componentes clave de la solicitud.

Identifica información crítica, prioridades y posibles inquietudes.

Ayuda al técnico a comprender solicitudes complejas.

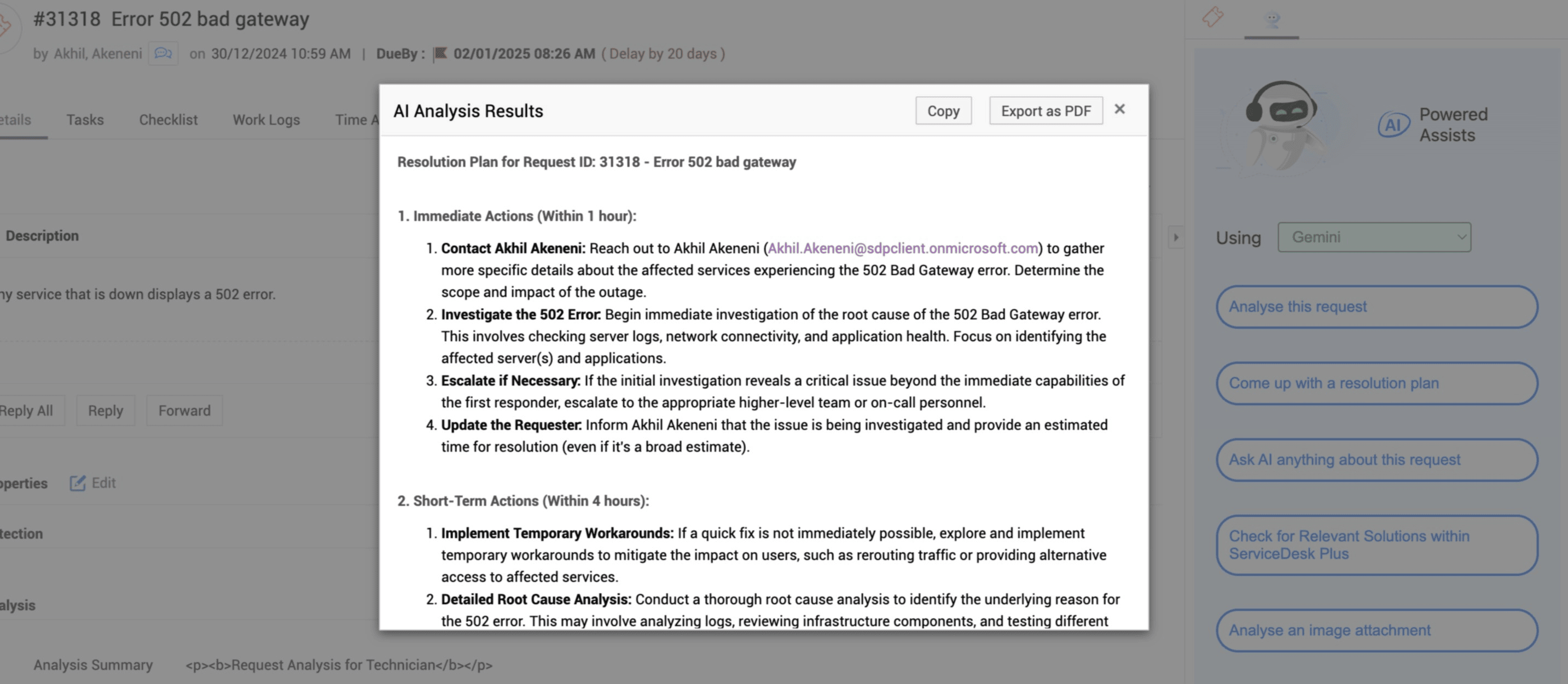

Plan de resolución estructurado

Genera una estrategia de resolución estructurada, paso a paso, teniendo en cuenta el contexto de la solicitud y las mejores prácticas.

Estandariza los enfoques de resolución entre los equipos al incluir estimaciones de tiempo y requisitos de recursos.

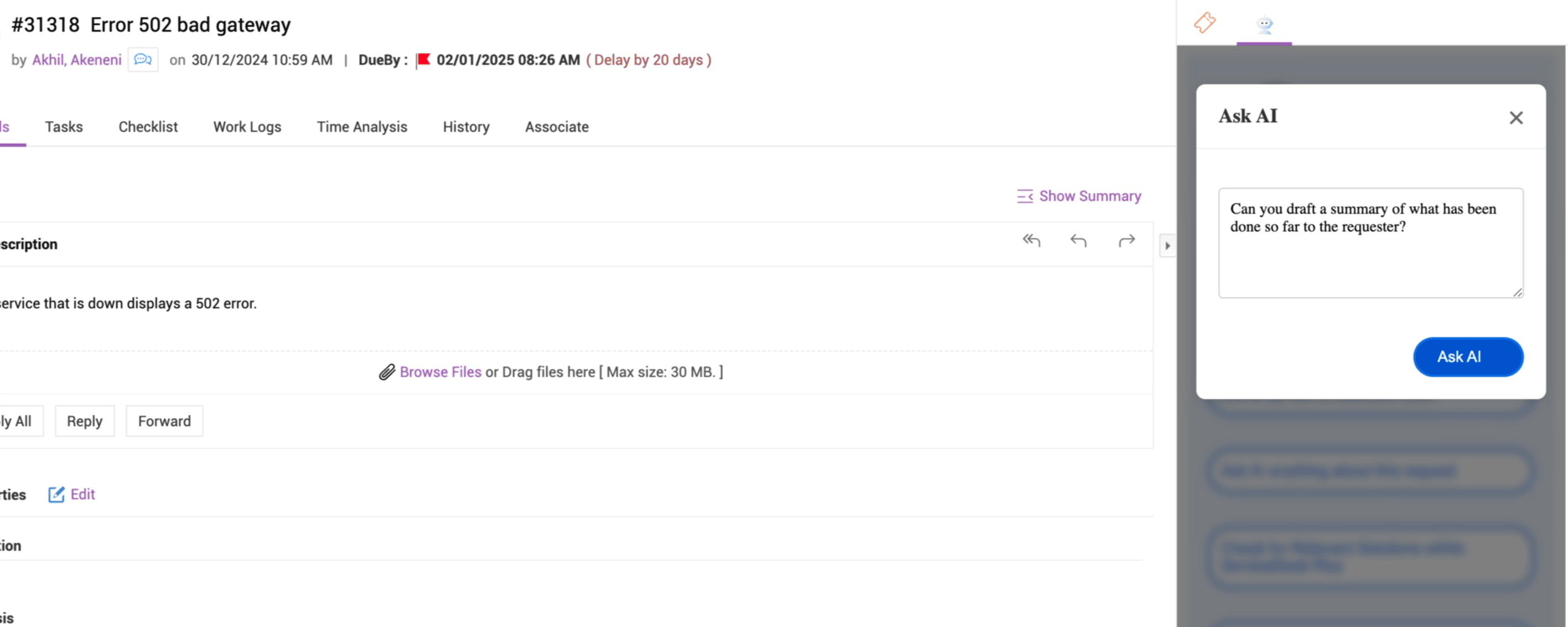

Pregunte cualquier cosa sobre una solicitud (Ask AI)

Permite a los usuarios hacer preguntas a la IA en lenguaje natural sobre cualquier aspecto de la solicitud.

Ayuda a aclarar aspectos complejos o detalles técnicos y respalda la toma de decisiones con información impulsada por IA.

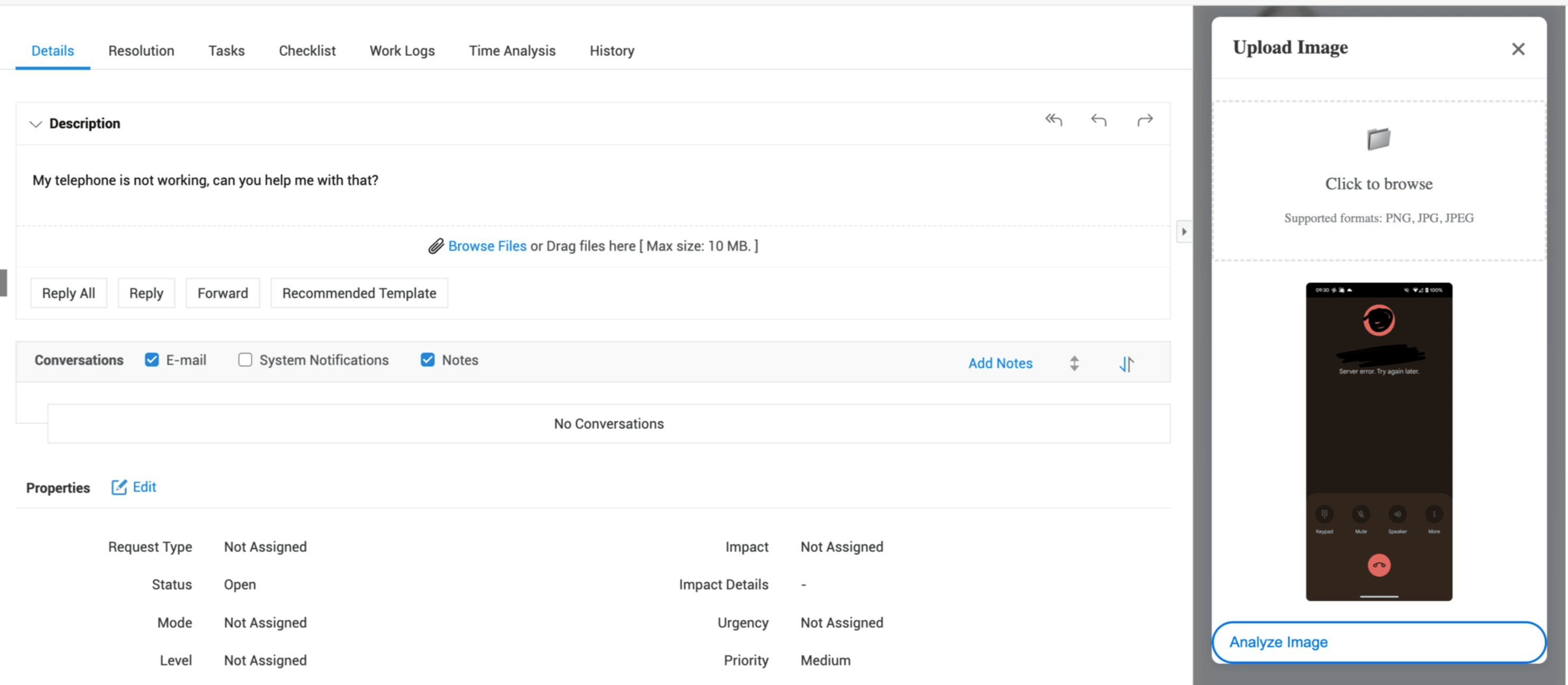

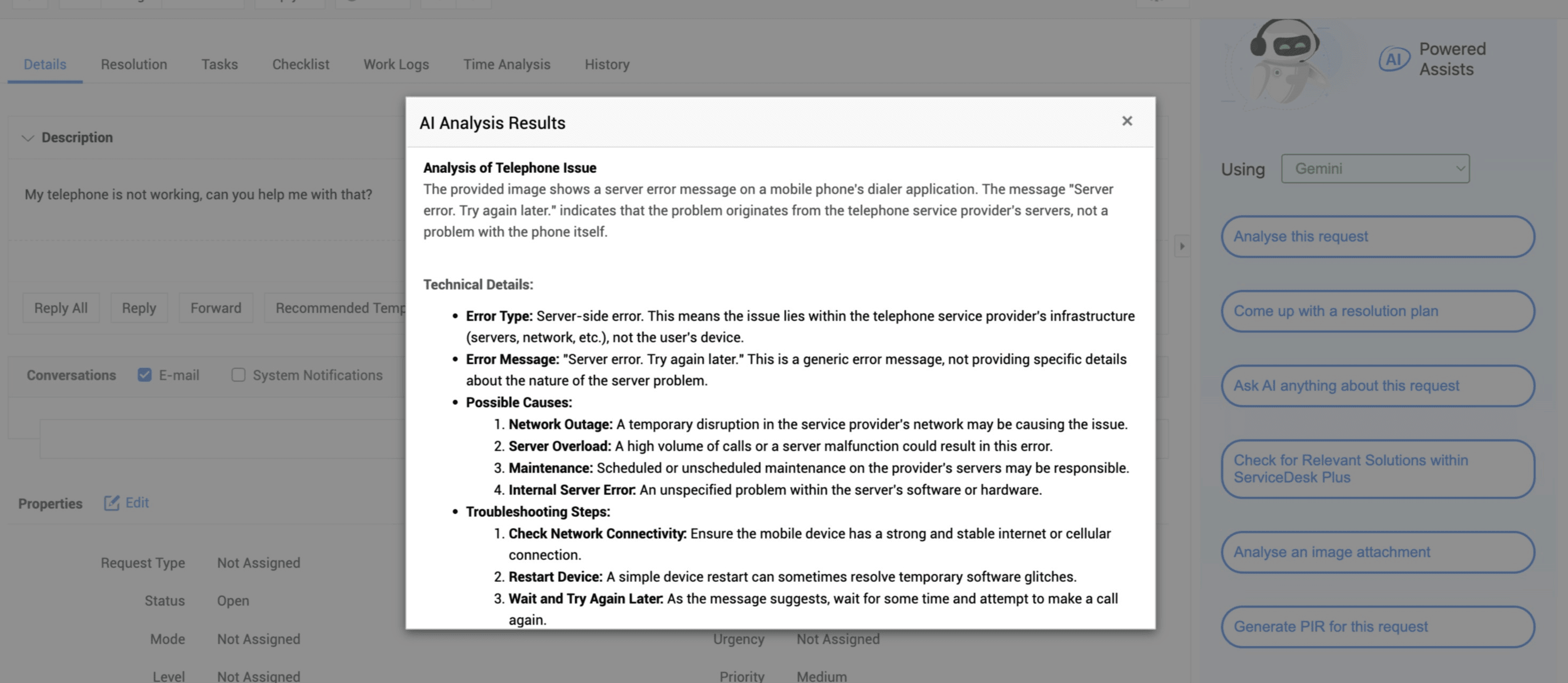

Análisis preciso de imágenes (solo Gemini)

Los usuarios pueden cargar imágenes, pedir ayuda a la IA y recibir el análisis de la IA según el contexto de la solicitud.

Combina contexto visual y textual para ayudar a los técnicos a comprender los problemas de un vistazo.

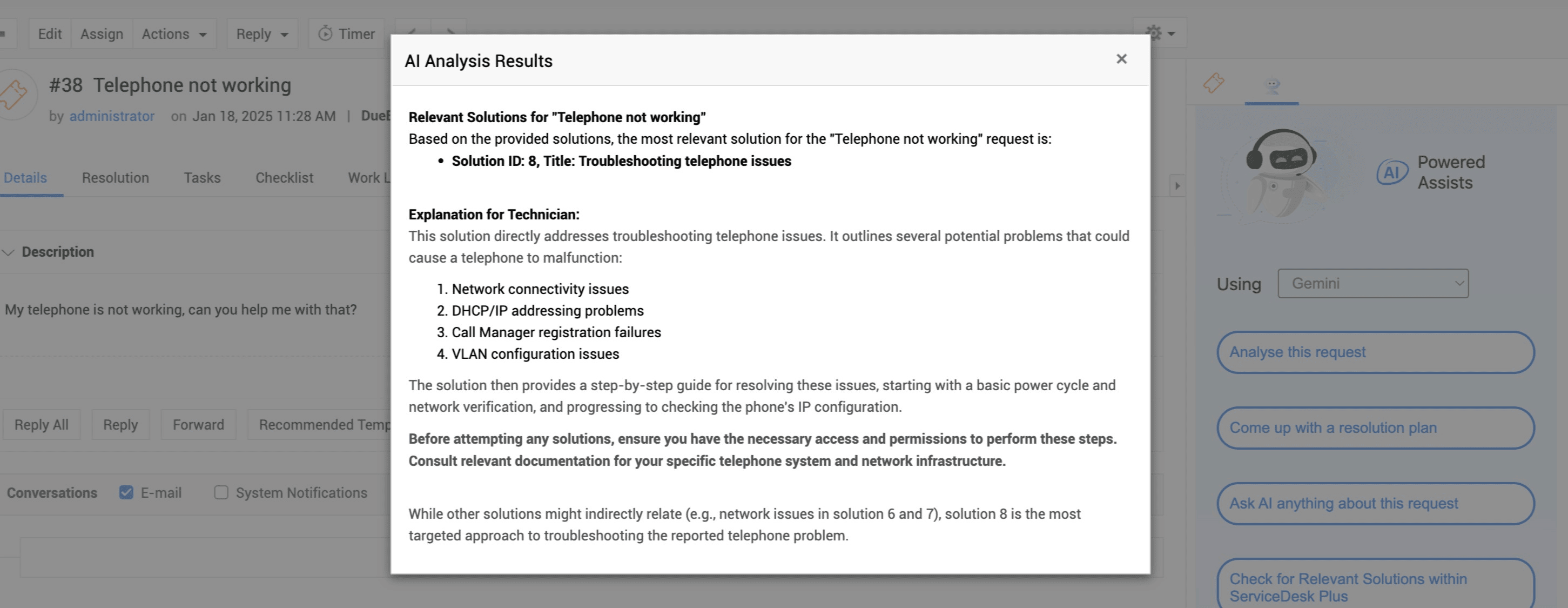

Soluciones relevantes dentro de ServiceDesk Plus (solo Gemini)

Busca soluciones accesibles para los técnicos dentro de ServiceDesk Plus y encuentra las que pueden ser relevantes para la solicitud.

Reduce el tiempo de resolución al encontrar la solución correcta en la base de conocimientos existente.

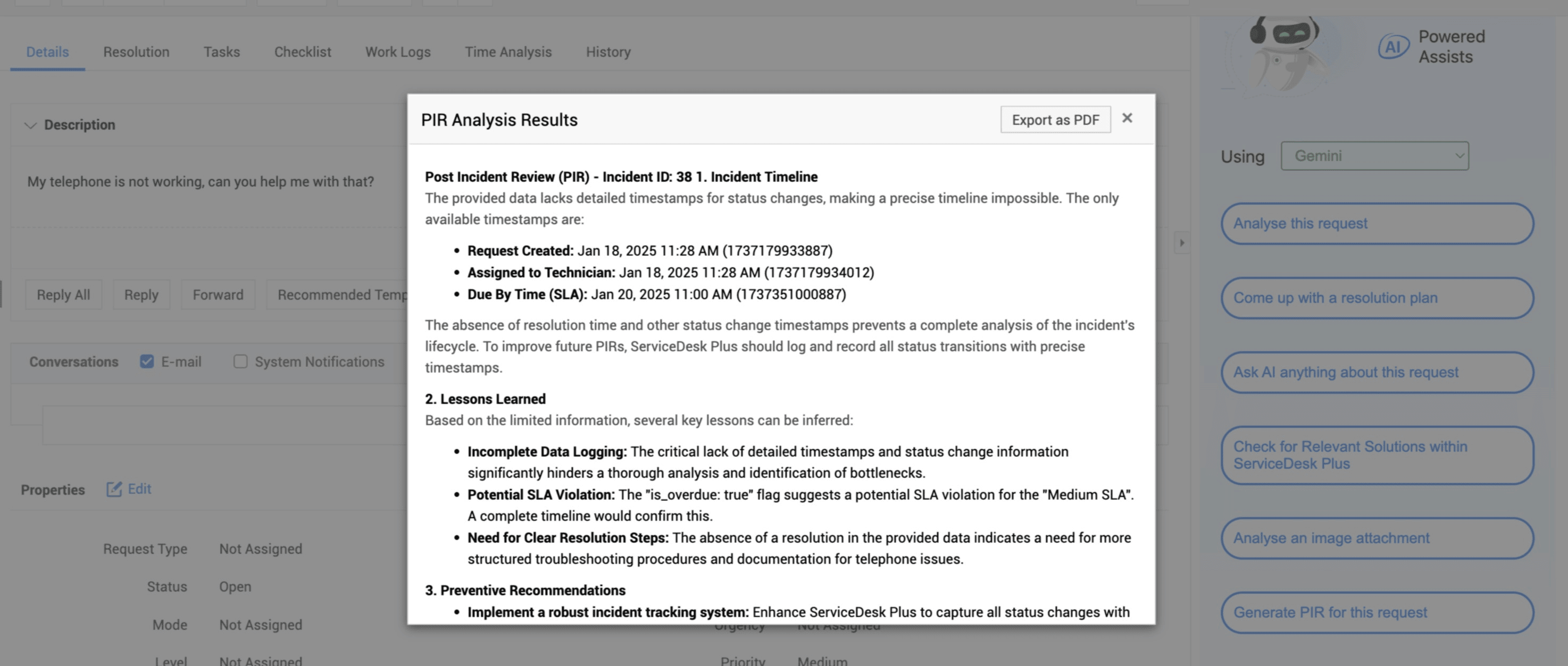

Revisión posterior al incidente optimizada (PIR)

Crea informes detallados posteriores al incidente.

Incluye la línea de tiempo del incidente, el análisis de impacto y los pasos de resolución, al tiempo que captura métricas clave y aprendizajes del incidente, agilizando el proceso de documentación del incidente.

Incluye un botón de Exportar como PDF para descargar el PIR generado sin problemas.

Configuración de los proveedores de IA

Configuración de Gemini

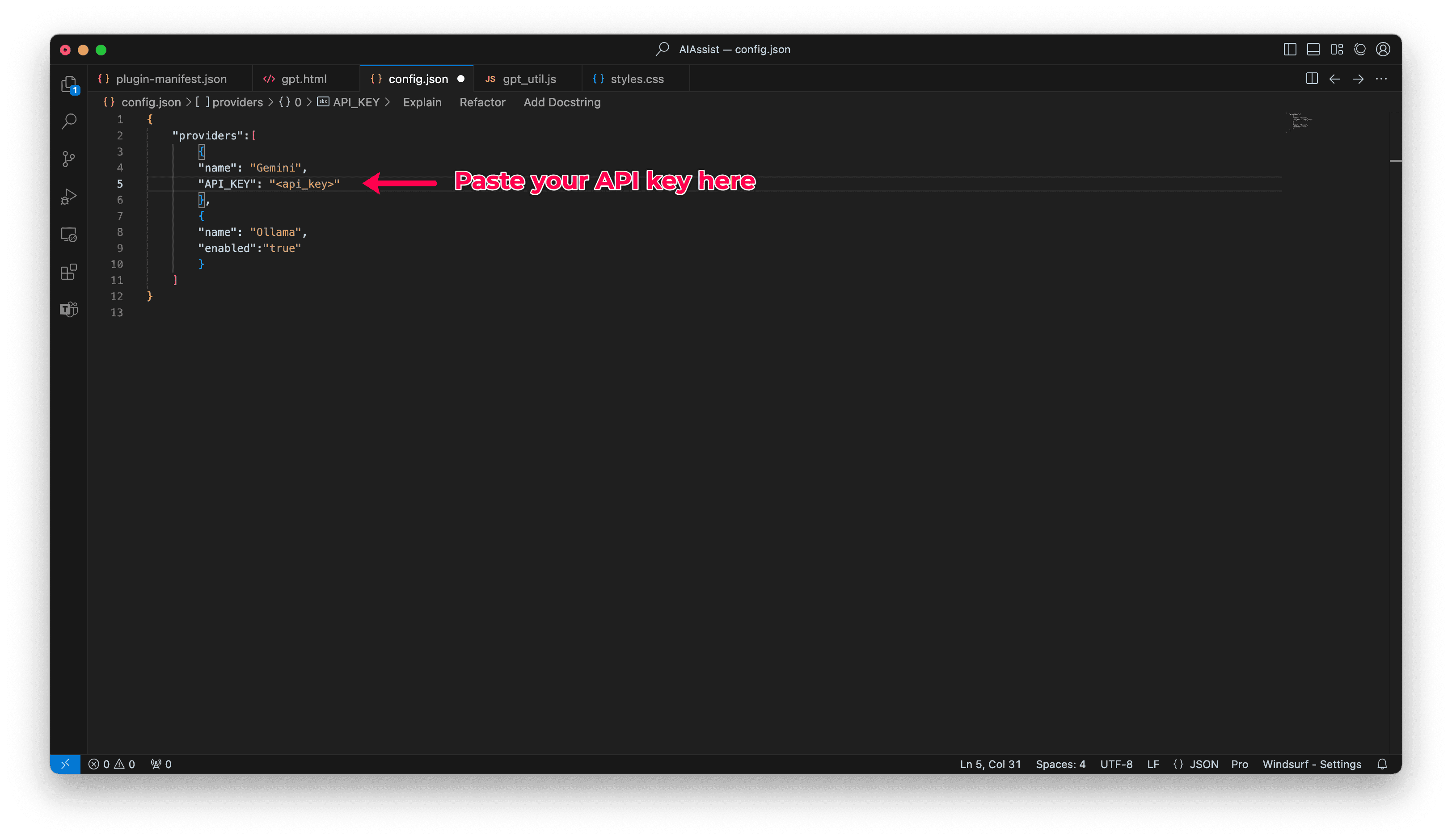

El proveedor Gemini se configura en config.json dentro del archivo zip del widget. Cada proveedor tiene su propio bloque de configuración.

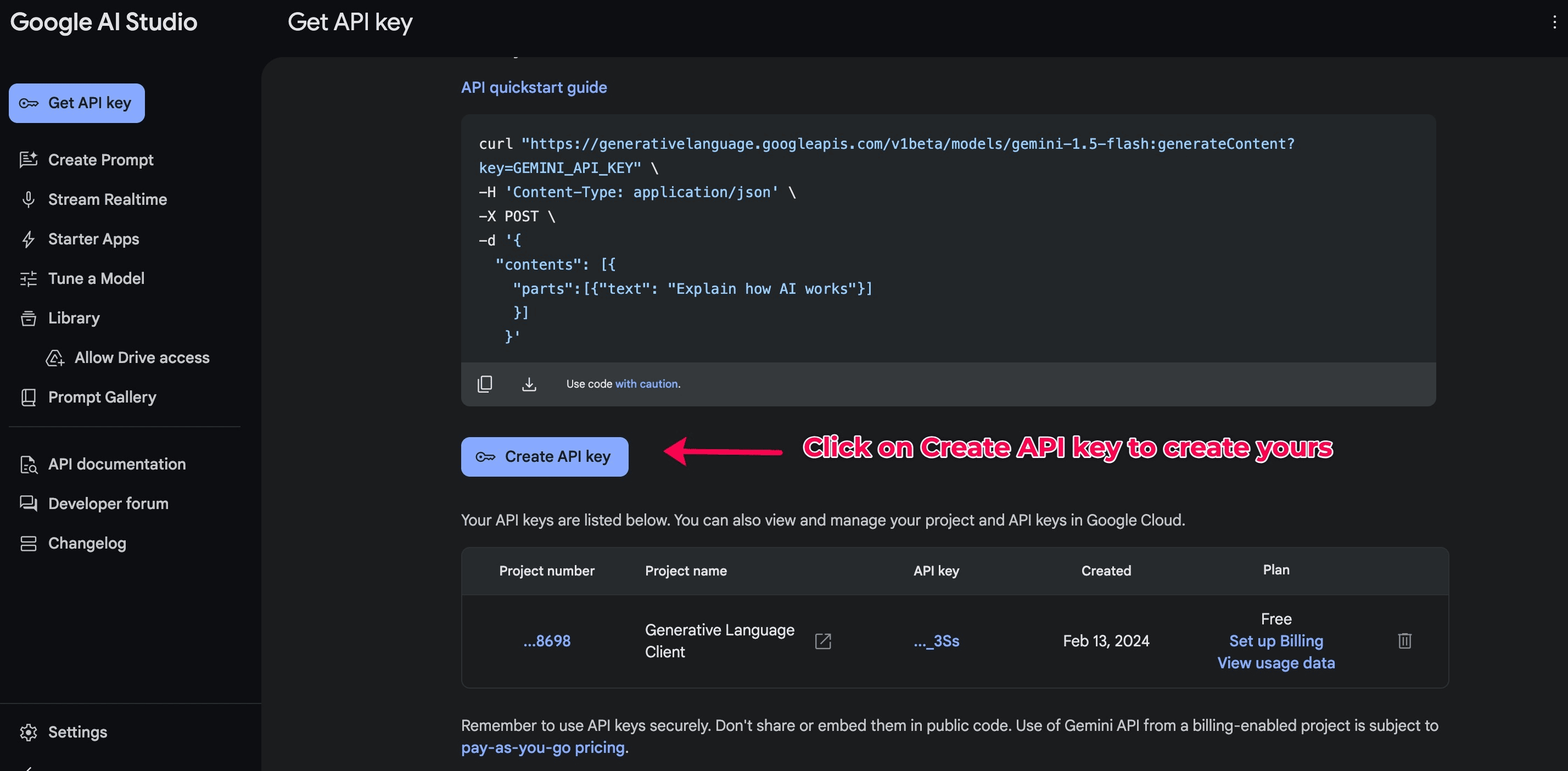

La configuración de Gemini requiere una clave API. Para obtener la clave API de Gemini:

Vaya a https://aistudio.google.com/live e inicie sesión con sus credenciales de Google.

Haga clic en Get API key en la parte superior izquierda.

Haga clic en Create API key para generar su clave API única.

Copie la clave API generada.

Descomprima los archivos del widget.

Abra config.json en un editor de texto.

Pegue la clave API como valor en el parámetro API_KEY de Gemini.

Después de actualizar el parámetro, comprima todos los archivos del widget juntos.

Vaya a Admin > Developer Space > Custom Widget > + Custom Widget.

Cargue y guarde el archivo comprimido para usar Gemini como proveedor de IA para este widget.

Detalles de implementación de Gemini

Modelo utilizado: Gemini 1.5 Flash

Capacidades:

Análisis de texto

Análisis de imágenes

Usa llamadas directas a la API REST

Admite entradas multimodales (texto + imágenes)

Configuración de OpenAI

Para configurar una conexión para OpenAI en ServiceDesk Plus,

Paso 1: Crear un servicio

Vaya a Admin > Developer Space > Connections > Custom Services > Create Service.

Ingrese el Service name y el Service Link Name como openAI.

Configure el Authentication Type como Basic Authentication.

Haga clic en Create Service.

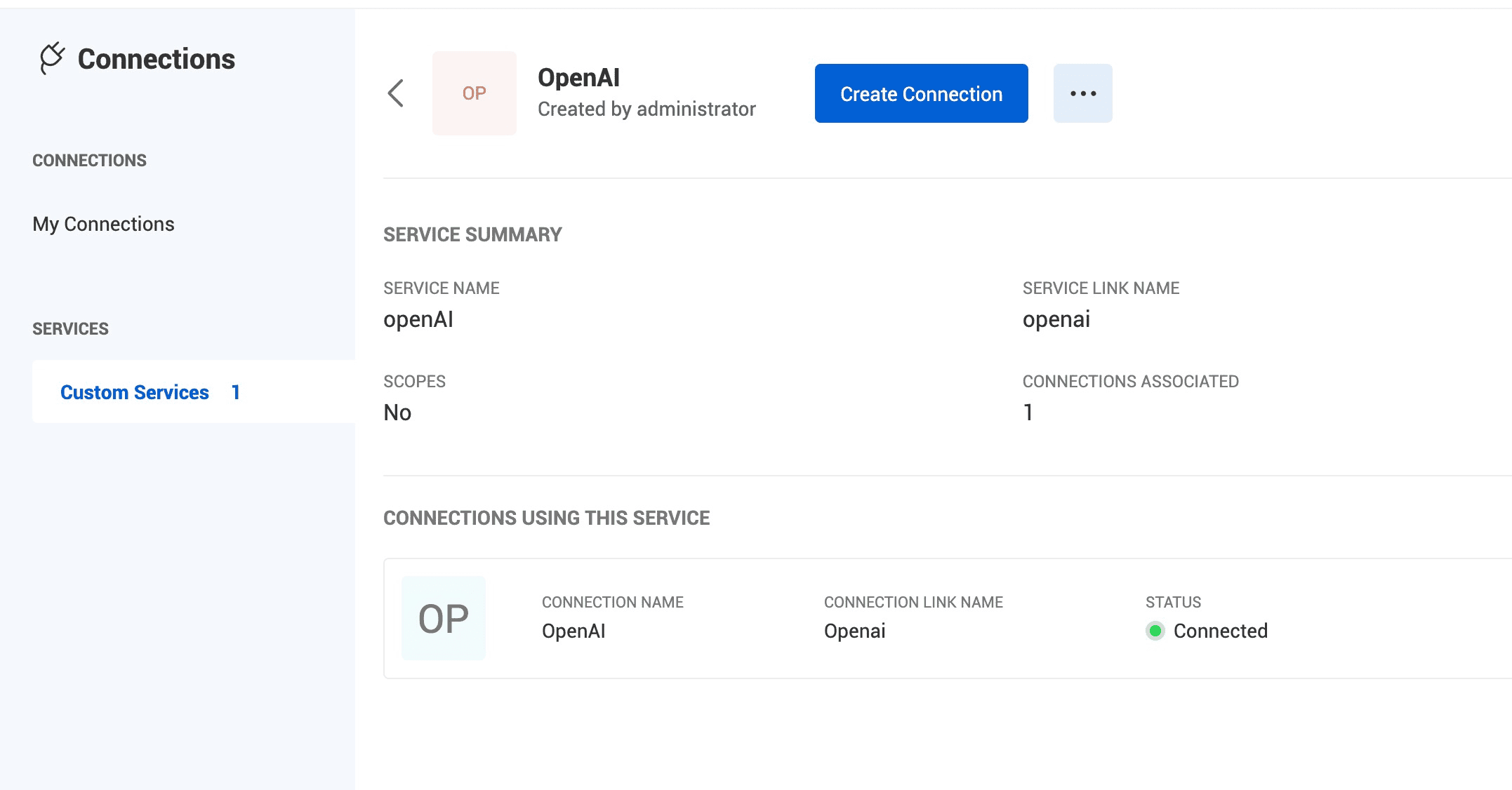

Paso 2: Crear una conexión

Después de crear el servicio, haga clic en Create Connection.

Ingrese el Connection name y el Connection Link Name como openAI (similar al nombre del servicio).

Haga clic en Create and Connect.

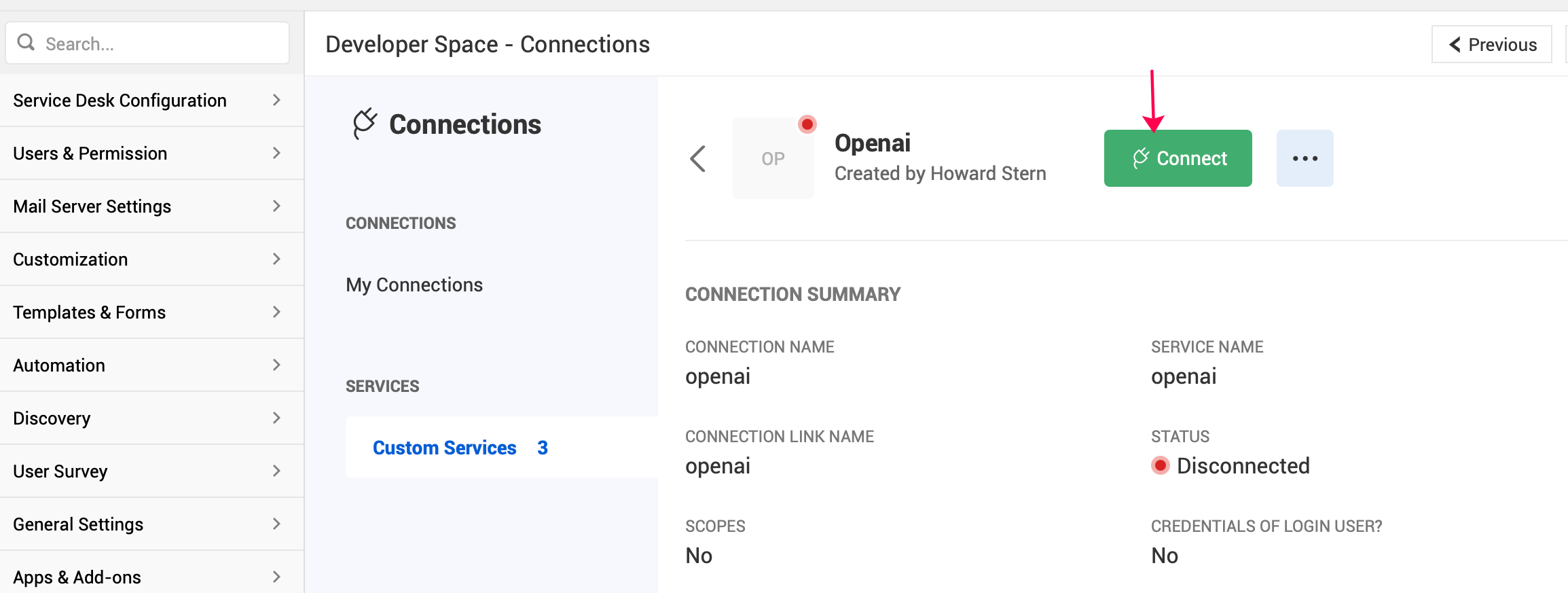

Paso 3: Establecer la conexión

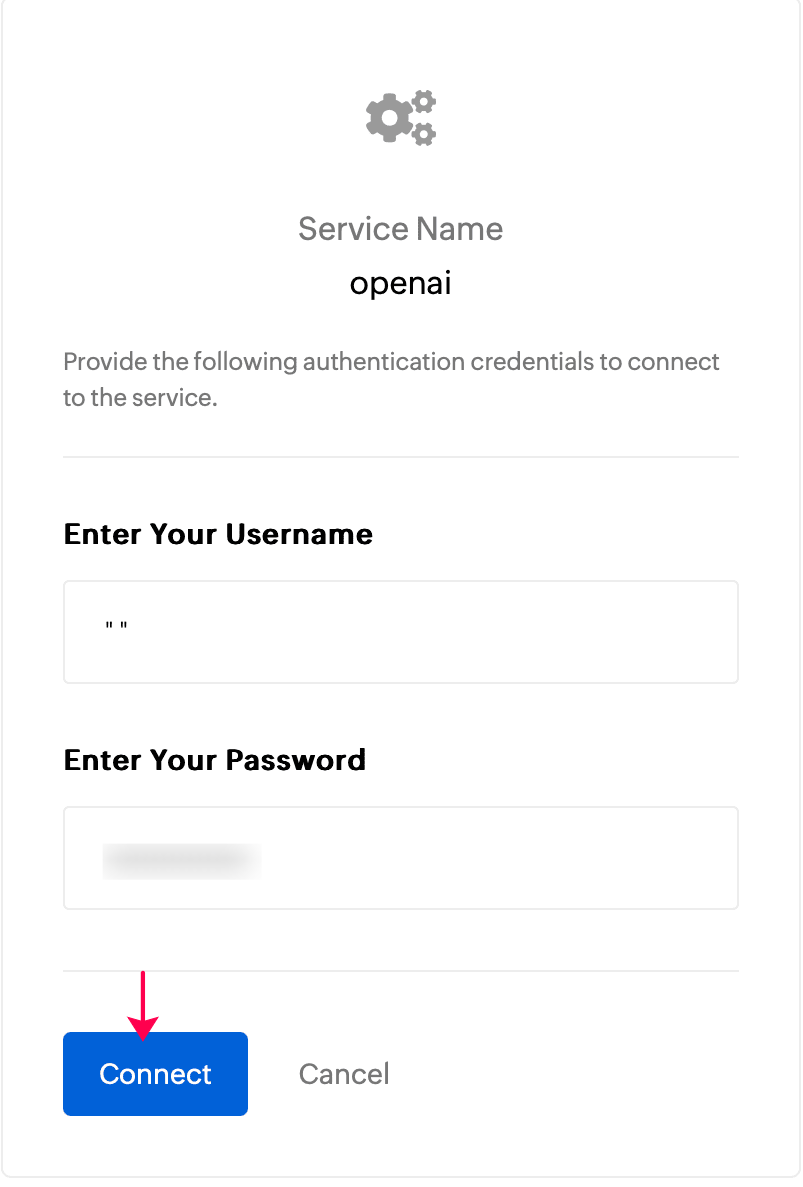

Haga clic en Connect. Se le pedirá que ingrese el nombre de usuario y la contraseña.

Ingrese " " como nombre de usuario (nombre de usuario en blanco), y la contraseña debe ser la clave API de OpenAI.

Para crear/obtener su clave API de OpenAI, consulte esta página: https://platform.openai.com/api-keys. Puede usar su clave API existente o crear una nueva clave secreta y luego usarla como contraseña.

Después de completar el nombre de usuario y la contraseña, haga clic en Connect.

Paso 4: Configurar el widget personalizado

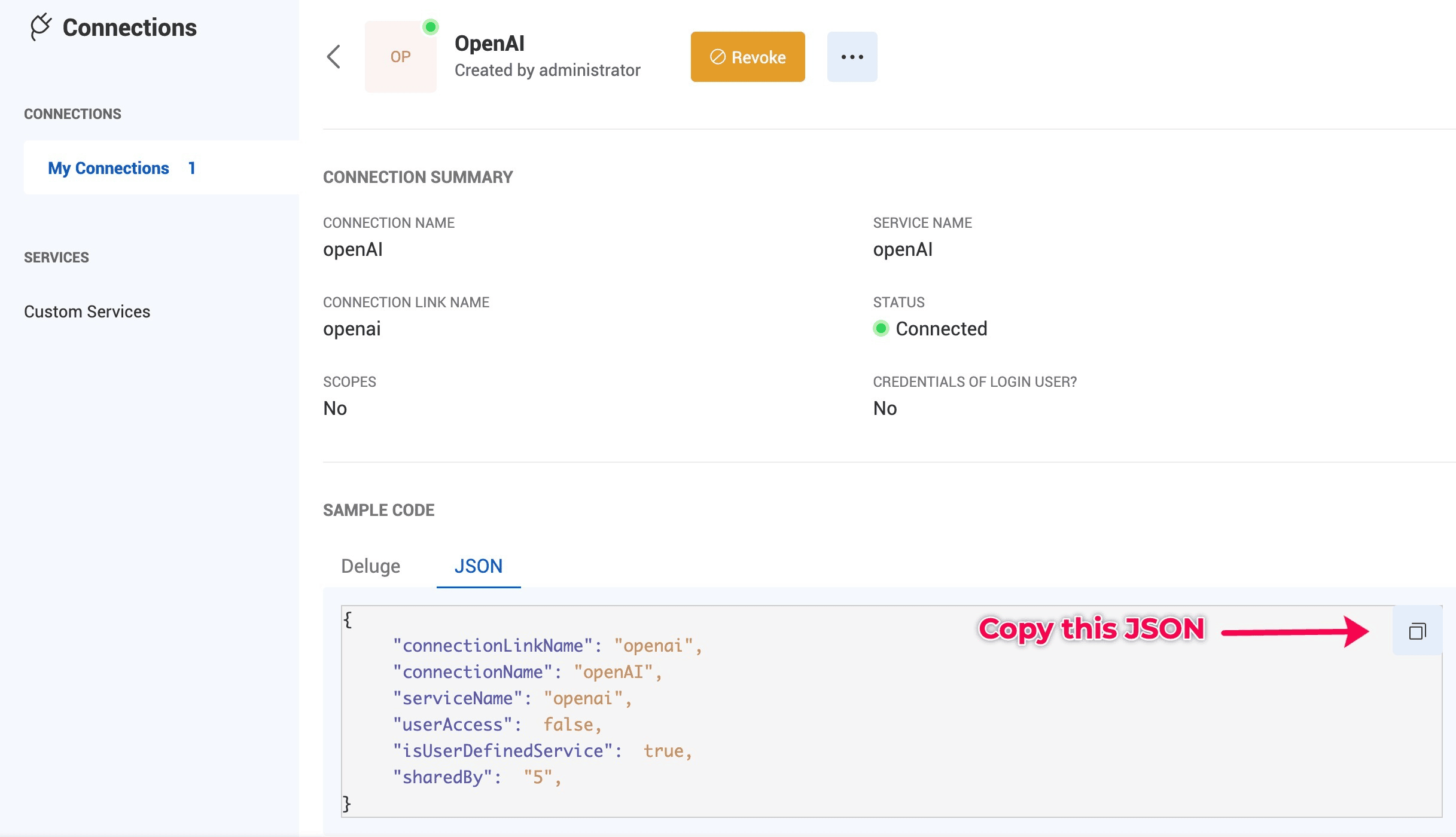

- Copie el JSON de la conexión de la siguiente manera:

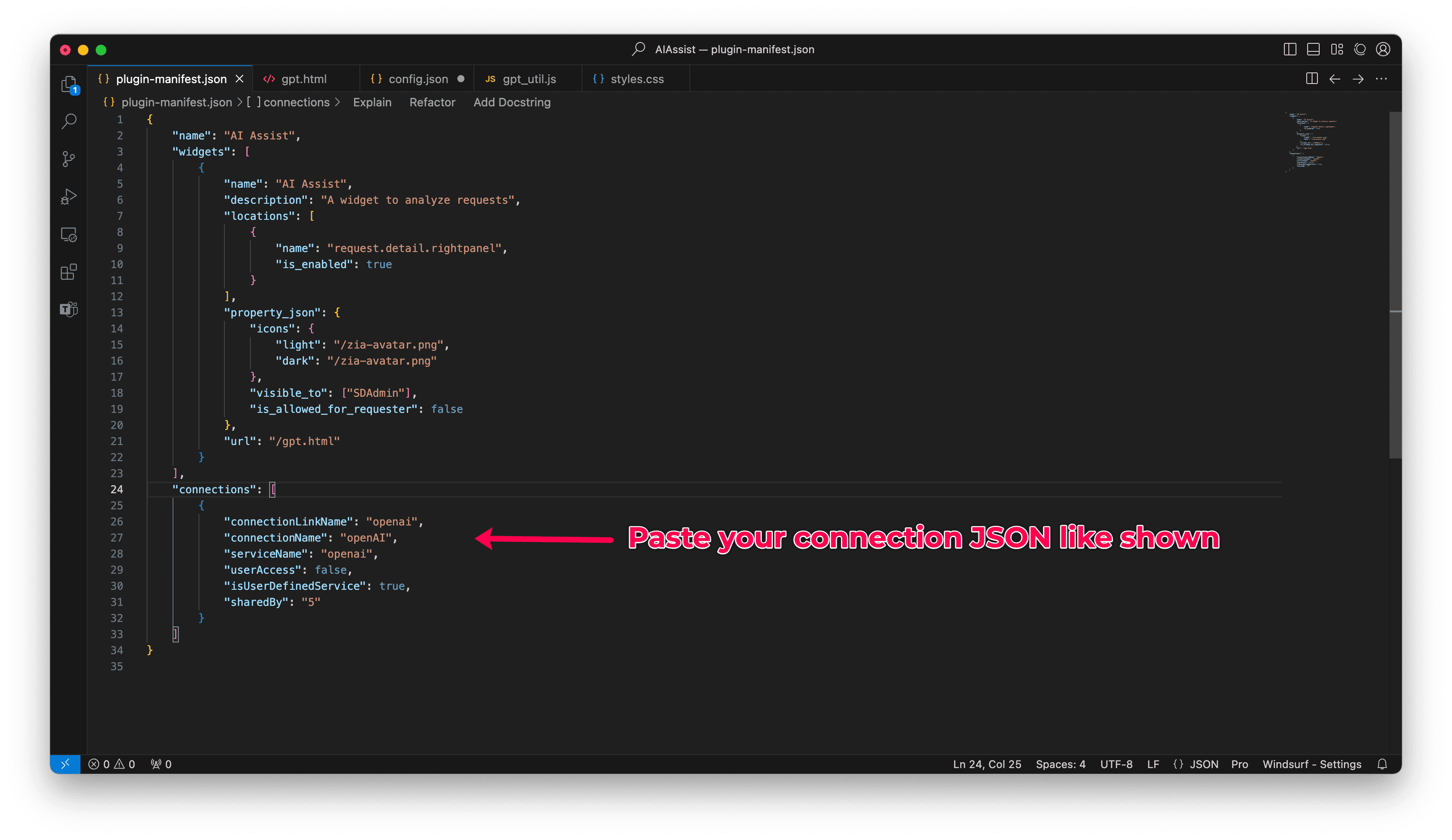

Vaya al archivo zip del widget y abra el archivo plugin-manifest.json.

Pegue el JSON en el arreglo de conexiones y guarde el archivo.

Seleccione y comprima todos los archivos del widget.

Cárguelo en Admin > Developer Space > Custom Widget para usar OpenAI como su proveedor de IA para este widget.

Detalles de implementación:

Modelo utilizado: GPT-4

Capacidades:

Análisis de texto

El prompt del sistema establece el contexto como "un asistente útil que analiza las solicitudes de los usuarios"

Los mensajes se estructuran en formato de chat con roles de sistema y usuario.

Extremo de API: https://api.openai.com/v1/chat/completions

Configuración de LLM locales con Ollama

Para usar LLM que se ejecutan completamente en su máquina de servidor local, haga clic aquí.